危險!別再讓 AI 給你看病了!

以前大家經常說“不要在網上亂搜醫療建議”,因爲網上信息不那麼可靠,患者又不可能準確描述自己所有的症狀成了而大語言模型 AI 時代,又出現了一種新風險,網上尋醫問藥禁忌中,恐怕必須再加上一條“不要隨便讓 AI 提供醫療建議”了。

圖片截自論文頁面

不久前《內科醫學年鑑·臨牀病例》(Annals of Internal Medicine: Clinical Cases)就報道了一起神奇的病例——有人因爲聽信 AI,把自己喫成了多年未見的溴中毒。

AI 真敢建議,患者真敢實踐

這個病例,只能說從頭到腳都寫着奇葩二字。

這人一開始去急診室,是說他鄰居在給他下毒,當時沒有說自己在喫任何藥物。住院之後才得知,他平日有好多食物都不喫,水也是自己在家蒸餾了才喝,在醫院雖然一直說口渴但又不信任別人給他的水。住院 24 小時後,他的偏執狂症狀越來越嚴重,出現了幻聽幻視,還試圖從醫院逃跑,結果被強制收押並打了抗精神病藥。

等到藥物生效,患者冷靜下來之後,醫生纔算問出來真實情況。原來,這位患者特別特別害怕喫到對身體有害的食物,這也不喫那也不喫,已經把自己餓到了多種維生素欠缺的地步了。而就在這時,他又在網上看到了關於食鹽的文章,得知食鹽對身體很不好。

就在研究食鹽危害的過程中,他靈機一動,發現了一個巨大的“華點”:食鹽的化學成分是氯化鈉,但爲什麼文獻都在關注鈉對身體的傷害,沒人關注氯呢?超市只能買到低鈉鹽,爲什麼買不到低氯鹽呢?難道這個氯,對身體竟然沒有一點害處嗎?能不能不攝入氯呢?

圖庫版權圖片,不授權轉載

既然網上沒人說,那就得靠自己了,患者詢問了 ChatGPT,結果 AI 給出了“非常具有可操作性”的建議:用溴來代替氯。

這位患者真的這麼幹了,然而這並不是個好主意。

看似六七八分像,其實完全不一樣

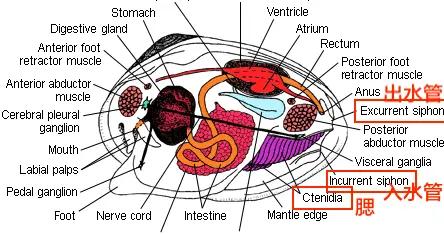

溴,元素符號 Br,在週期表上位於氯的正下方,是個普通人不太容易接觸到的元素。大概一百年前,溴中毒還算是醫生經常能遇到的事情,因爲當時溴被認爲擁有鎮靜效果,很多非處方藥物裏含有溴鹽,什麼治失眠、治焦慮、治歇斯底里,都能用到。當然,要是一不小心喫多了,那就從治焦慮一躍而成致焦慮,引發運動失調和各種幻覺,嚴重的可以導致昏迷,順便還附送厭食和便祕之類的症狀。

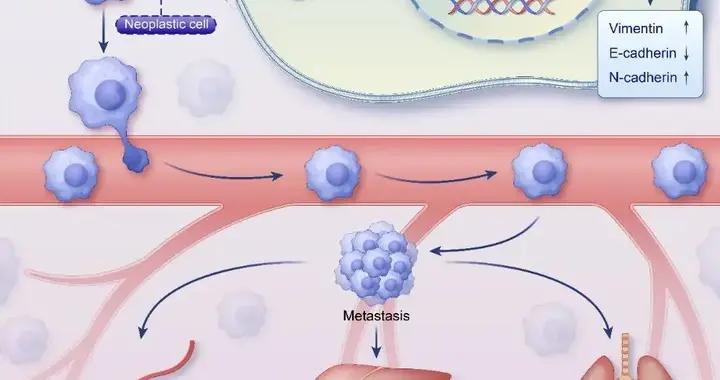

爲什麼會這樣呢?溴和氯都是鹵族元素,最外層都是 7 個電子,化學性質很相似,在簡單的化學反應裏確實可以相互代替。人體攝入溴離子後,它也會“冒充”氯離子去參與各種生化反應。

但是一旦反應真的開始,它就露餡了:生化反應非常精密,哪一步速度稍微跟不上,活性稍微差一點,就會導致大範圍脫節。神經系統的正常運行相當依賴於氯離子,所以如果被溴離子冒名頂替,遭到的破壞也尤其嚴重。

人體可以排出體內的溴離子,但速度算不上很快,大概 9 到 12 天才能排出一半。所以如果持續攝入含溴的食物或者藥物,溴可以逐漸積累,造成更大傷害。歷史上,溴中毒一度佔到了精神病院住院人數的 8%。後來大家都知道了溴的危險性,藥物紛紛棄用它,溴中毒也就難得一見了。

沒想到如今因爲 AI 的建議,溴中毒又迎來了難得的“文藝復興”。可喜可賀,還好,這位病人在住院三個星期之後,中毒症狀逐漸緩解而順利出院了,兩週後的複查也沒有問題。希望他能就此放棄對低氯飲食的追求吧。

這種“精神”病

大概已經在路上了

如此說來,雖然這個病例本身是罕見的奇葩,但它卻反映了更廣泛的現象,那就是所謂的“聊天機器人精神病”(Chatbot psychosis)或者“ AI 精神病”。

這個詞語形容的不是 AI 本身犯病了,而是用戶在和大語言模型 AI 聊天的過程中產生或者加劇了精神病症狀。一個非常典型的場景是,用戶相信某種陰謀論,AI 沒有否定反而迎合並鼓勵用戶,並且幻覺出支持這一陰謀論的各類證據,導致用戶深陷其中,日常生活和社交瀕臨崩潰,甚至採取極端行爲。

目前這一現象還不是正式認定的診斷,也幾乎沒有相關科學研究,但已經引起了媒體的重視,積累了數量不少的個案。或許不久之後,我們就能知道這一現象的嚴重程度究竟如何。

相信奇怪的信念,這本身相當常見。但人終究是社會動物,需要身邊同道之人的支持,才能毅然決然地一路走進溝裏出不來。歷史上要找到這樣的同伴往往需要拋家棄子,互聯網出現後就可以到小衆論壇裏尋找同好了。

而生成式 AI 的時代,連人類同道都不需要,管你有什麼怪念頭,AI 都能給你提供無限的支持和情緒價值。畢竟目前的大語言模型距離真正的通用智能還頗有一段距離,如果不把它設定爲“應聲蟲”,就無法給用戶良好的使用體驗。但是這種體驗是否值得付出幻覺、謠言和 AI 精神病的代價,我們作爲普通用戶有沒有選擇權,那就是另一個問題了。

據報道,OpenAI 已於 10 月 29 日更新了 ChatGPT 的使用政策,禁止其在某些原本被認爲最具價值的應用領域提供服務 —— 例如解讀醫學影像、協助醫療診斷,以及提供法律或財務建議。

此舉旨在防止 ChatGPT(以及其他任何 OpenAI 模型)輸出可能被視作專業性、受託性或具有法律約束力的建議,以符合歐盟《人工智能法案》和美國食品藥品監督管理局的相關指導要求。

策劃製作

作者丨範崗 科普作者

審覈丨於乃功 北京工業大學教授 中國人工智能學會理事

孫明軒 上海工程技術大學教授、中國科普作家協會會員

策劃丨丁崝

責編丨丁崝

審校丨徐來、張林林