老黃:別叫我賣芯片的,其實我是一個“超級包工頭”

當上萬人屏住呼吸,等黃仁勳像往年一樣掏出一塊巨型 GPU 時,他卻在主題演講時重點講一顆叫 Vera 的 CPU。

老黃沒跑題。恰恰相反,這可能是理解英偉達 GTC 2026 最重要的一把“鑰匙”:英偉達正在從“賣全世界最好的 GPU”轉變爲“承包整座 AI 工廠的所有零件、管線、操作系統,甚至是施工藍圖”。

GPU 仍然是心臟(算力核心),但心臟是無法獨活的。

35 倍的提升!

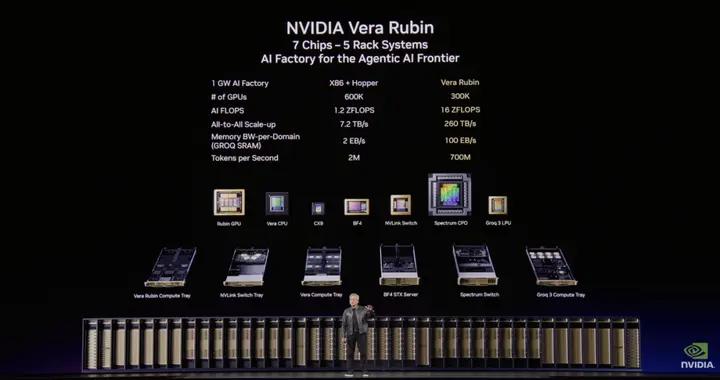

先聊硬件。今年 GTC Keynote 的核心是 Vera Rubin 平臺。不是一顆芯片,而是一整套計算系統:七顆全新芯片、五款機架級系統、一臺超級計算機。

英偉達 Vera Rubin 平臺的所有芯片集合|來源:英偉達官方

數字層面看,它就是一頭參數怪獸。

Vera Rubin NVLink 72 的峯值算力達到 3.6 Exaflops,搭載 HBM4 顯存(288GB),GPU 之間的 NVLink 互連帶寬甚至能飆到 260TB/s。

怎麼理解這個帶寬?上一代 Blackwell 的 NVLink 就像一條省級高速公路,Vera Rubin 好比是直接在 72 顆 GPU 之間修了一張高鐵網,每顆芯片到任何一顆相鄰芯片的數據延遲都被拉平。全液冷設計意味着這臺機器在滿載時依然安靜得像一臺冰箱,而不是像上一代那樣嗡嗡作響。

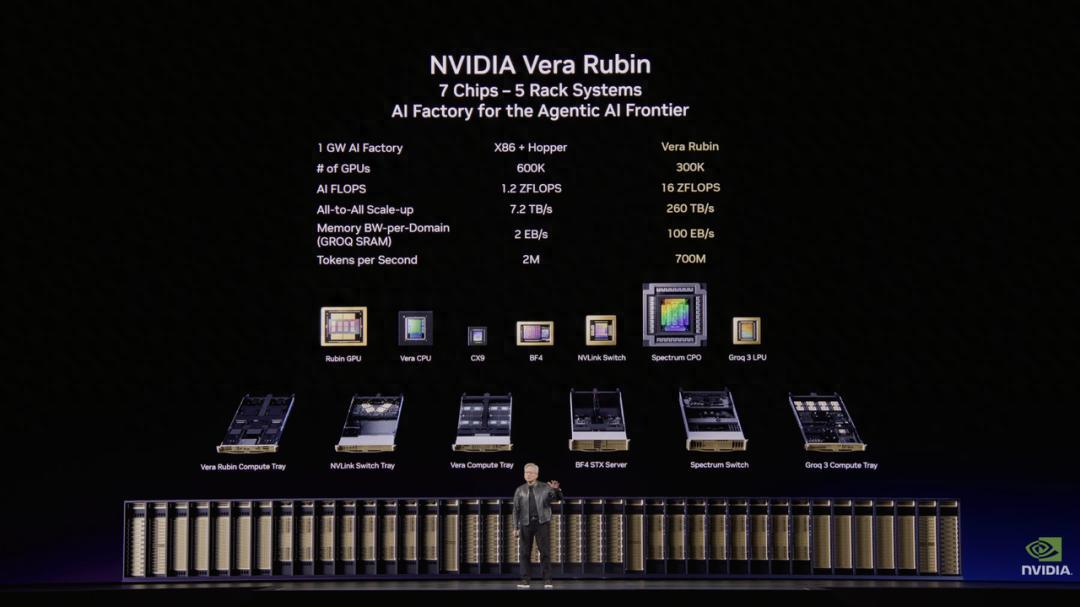

Vera CPU 渲染圖|來源:英偉達官方

但真正讓人意外的是 Vera CPU。這顆處理器採用 LPDDR5,通常只出現在手機和超薄筆記本里的低功耗內存。把它塞進數據中心 CPU 是什麼意思?

英偉達認爲,AI 工廠裏 CPU 的角色不再是“通用計算老黃牛”,而是“智能體工作流的調度員”。它不需要暴力堆內存帶寬,而是需要用最少的電把數據精準地搬到該去的地方。單線程性能和能效比達到現有主流 CPU 的 2 倍。

對英特爾和 AMD 來說,這一刀捅得很精準。

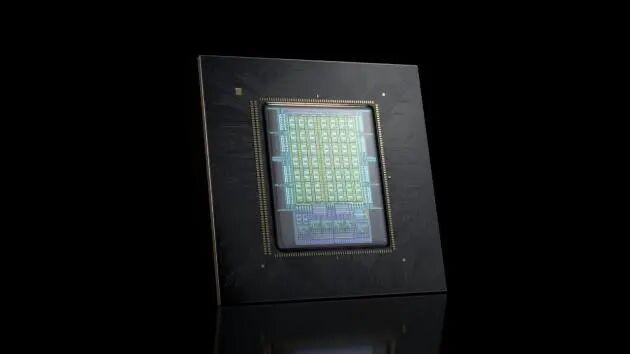

第三位主角是 Groq 3 LPX,英偉達稱之爲 LPU(語言處理單元)。它內部堆滿了 SRAM(靜態隨機存取內存),三星代工,只負責一件事:以極低延遲把 Token 一個接一個地"吐”出來。

爲英偉達 Vera Rubin 平臺打造的低延遲推理加速器 Groq 3 LPX |來源:英偉達官方

如果說 GPU 是負責“想明白”的大腦,LPU 就是負責“說出來”的嘴巴。AI 模型的推理生成環節(decode)正是當前最卡喉嚨的瓶頸,LPU 就是爲打通這個瓶頸而生的。

這三顆芯片組成了一個微妙的分工三角:GPU 負責重計算,CPU 負責調度編排,LPU 負責極速輸出。這套異構推理架構配合英偉達自研的 Dynamo 調度軟件,最終實現了驚人的效果:

每兆瓦的 Token 吞吐量相比上一代 Blackwell 提升 35 倍。不是 35%,是 35 倍!

從“一間房”到“一棟樓”

如果芯片是器官,那連接它們的網絡就是血管。

Kyber Rack(對應 Rubin Ultra 級別)把單個 NVLink 域從 72 張 GPU 擴展到了 144 張。做到這一點靠的不是更粗的線纜,傳統線纜的物理極限已經逼近了,而是一種被稱爲“後置立式中板”的直連技術,簡單說就是把機架的背板變成了一塊巨大的芯片間高速公路,讓銅纜徹底退場。

這種做法很符合英偉達的工程哲學:如果傳統路徑走到頭時,那就重新定義“路”本身。

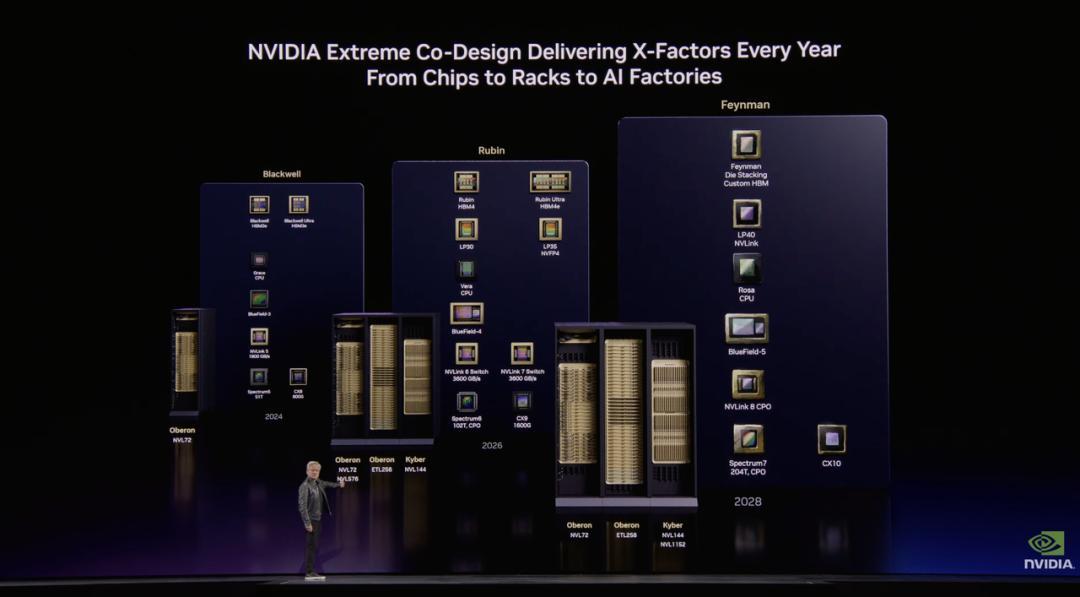

黃仁勳甚至預告了更下一代的 Feynman 架構(預計 2028 年推出),其中最值得關注的不是 GPU 本身的代號,而是一個技術細節:銅纜 Scale-up 與共封裝光學(CPO)Scale-up 將首次共存。

用通俗的話來說,芯片之間近距離用“電信號高速公路”,遠距離用“光纖超級鐵路”,兩套網絡無縫銜接。這會從根本上改變 AI 數據中心的物理佈局,把“一個房間”級別的集羣擴展到“一棟樓”甚至更大的規模。

NVIDIA 公佈了其下一代 AI 數據中心解決方案“Rosa Feynman”的更多細節,該方案採用 3D 芯片堆疊技術構建|來源:英偉達官方

Feynman 架構還引入了一顆全新 CPU,代號 Rosa,爲了致敬羅莎琳德·富蘭克林(Rosalind Franklin),那位用 X 射線晶體學揭示 DNA 雙螺旋結構的科學家。

黃仁勳在臺上說,就像富蘭克林揭示了生命隱藏架構的密碼,Rosa 的使命是編排智能體工作負載的完整結構:在 GPU、LPU、存儲和網絡之間實現高效調度數據、工具與 Token。

命名裏的野心已經寫得很明白了。

省電就是省錢

硬件再強,堆在機房裏不會自動變成印鈔機。黃仁勳深諳此道,他在演講中拋出了一句讓所有數據中心運營者冒冷汗的話:

“AI Factory revenues are equal to Tokens per watt. So with power constraints, every unused watt is revenue lost.(AI 工廠的營收等同於每瓦生成的 Token 數。在電力受限的鐵律下,每一瓦被浪費的電能,都是真金白銀的流失。)”

這句話的背後站着 NVIDIA DSX 平臺。這是一個基於 Omniverse 的 AI 工廠數字孿生系統。它把整座數據中心變成一個可實時模擬、可動態調度的虛擬沙盤。結合 AI 智能體自動分配算力和電網資源,DSX 宣稱最高可帶來 2 倍的系統級吞吐量提升。

從某種程度上來說,這件事的商業含義比任何一顆芯片都深遠。

基於 Omniverse 的 AI 工廠數字孿生系統——NVIDIA DS X 平臺|來源:英偉達官方

當前全球 AI 基建面臨的最大瓶頸不是芯片產能,而是電力資源的緊缺。北美的 GPU 集羣已經在跟電網搶電了,很多新建數據中心的落地週期不是被芯片交付週期卡住,而是被電力審批卡住。在這樣的特殊背景下,“軟件優化讓同樣一度電多吐出 Token”幾乎等於“憑空變出新的數據中心”。

這正是英偉達“賣系統、不只賣芯片”策略的精髓。

同時發佈的 BlueField-4 STX 存儲架構,可以被理解爲 AI 工廠的安保系統和後勤管線。它負責數據的安全傳輸、加密和調度,讓萬億參數的模型可以在分佈式存儲中高速讀寫,而不必擔心數據泄漏或擁堵。IBM、Dell 等一線廠商已經表態採用。

英偉達正在把自己從一個“硬件供應商”重新定義爲一個“AI 基礎設施的全棧方案商”。DS X、BlueField、Dynamo 推理調度器、各種 CUDA-X 庫……當客戶把這些全部用上之後,切換到 AMD 或其他競品的成本將變得異常高昂。

這是典型的平臺鎖定策略。它對英偉達的投資者是好消息,但對整個行業的長期競爭生態而言,值得警惕。

SaaS 已死,AaaS 當立

如果硬件和基建是“路”,那跑在上面的“車”就是 AI 智能體(Agent)。

黃仁勳在臺上說了一句判斷性極強的話:

“Every single SaaS company will become an AaaS company... an Agentic as a Service company.(每家軟件即服務公司都將轉型爲智能體即服務公司。)”

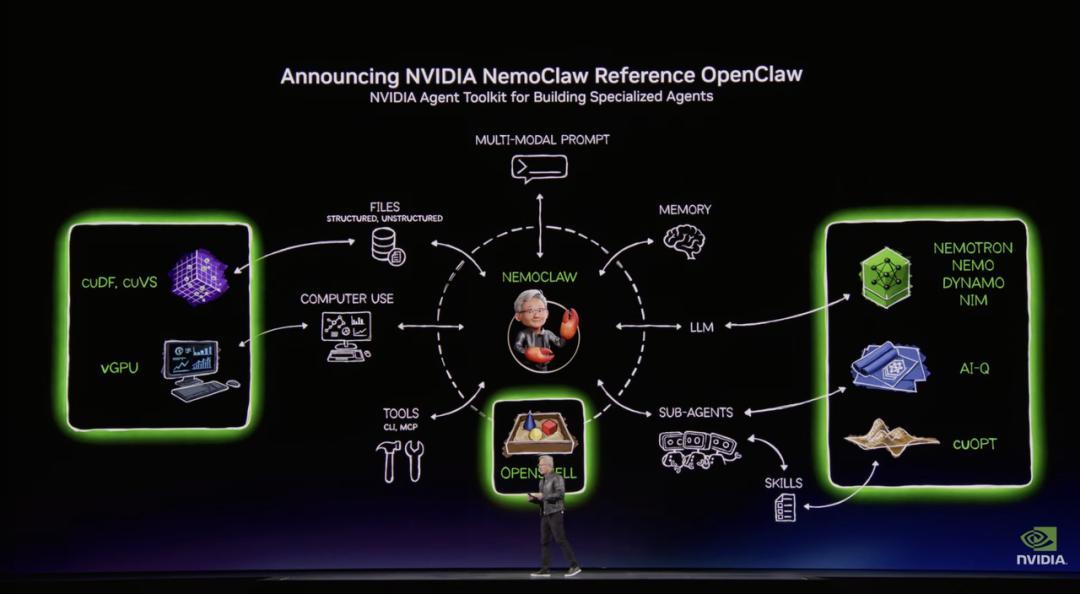

爲了讓這個預言儘快落地,英偉達發佈了 NemoClaw 參考架構。它在 OpenClaw 的基礎上增加了隱私和安全控制,核心是一個叫 OpenShell 的安全網關,負責策略執行、網絡隔離和隱私路由。你可以把它理解爲企業級 AI 智能體的“安全操作系統”。

當一個 AI 智能體需要在企業內網裏幫你查數據庫、調 API、發郵件時,NemoClaw 確保它不會越權、不會泄密、不會在生產環境裏“搞事情”。黃仁勳甚至說 Nemo Claw 可以成爲“全世界所有 SaaS 公司的策略引擎”。

這句話的潛臺詞是:別自己造輪子了,用我的就好。

開源側,英偉達同步宣佈成立 Nemotron 聯盟,聚攏了 Black Forest Labs、Cursor、Mistral、Perplexity 等一批當紅 AI 明星公司,圍繞六大前沿模型家族——語言與推理(Nemotron)、世界與視覺(Cosmos)、通用機器人(Isaac GR00T)、自動駕駛(Alpamayo)、生物化學(BioNeMo)、氣象與氣候(Earth-2),構建協作生態。

這套組合拳的戰略邏輯非常清晰:英偉達不想只做 AI 的“鏟子供應商”,它想做 AI 時代的操作系統層。 就像微軟當年通過 Windows 控制了 PC 生態一樣,英偉達正在通過從硬件到推理框架到智能體運行時的全棧佈局,試圖定義“AI 應用應該怎麼被構建和運行”。

帶着機器人謝幕,又一次

如果前面的一切都是在“數字世界”裏打轉,那 GTC 2026 下半場的主題就是:AI 如何長出一副“肉身”。

自動駕駛方面,英偉達首發了 Alpamayo 平臺,一個專爲自動駕駛設計的“思考與推理”AI 系統。與此同時,英偉達的NVIDIA Robotaxi Ready 平臺新增了比亞迪、現代、日產、吉利四大車企,合計年產能 1800 萬輛。 同時宣佈與 Uber 達成戰略合作,Robotaxi 將直接接入 Uber 的叫車網絡。

1800 萬輛的年產能意味着什麼?這大約是全球年汽車產量的五分之一。當然,“Robotaxi Ready”不等於“明天就能上路”。從硬件就緒到法規允許再到消費者信任,中間還有漫長的路要走。但英偉達的意圖很明確:先把硬件平臺鋪進去,等自動駕駛的法規窗口一打開,這些車就能通過軟件升級變成 Robotaxi。這是一個典型的“埋樁”策略。

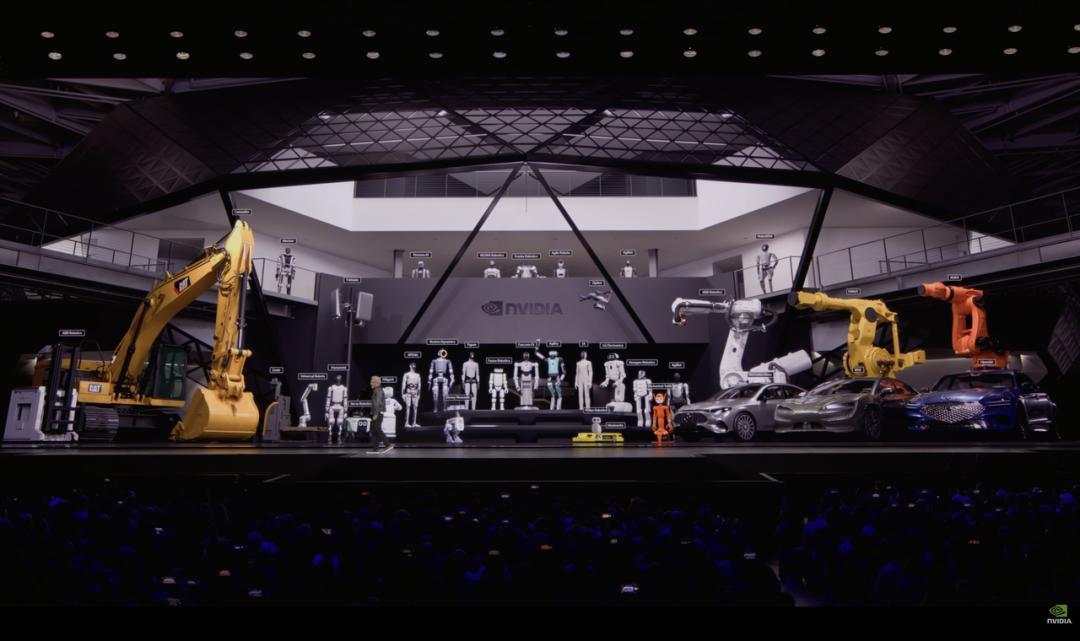

機器人領域的動作更大。英偉達全面開源了四大物理 AI 基石:Isaac Lab(機器人訓練評估)、Newton(可微分物理引擎)、Cosmos(世界模型)和 GR00T(通用機器人推理基礎模型)。展區裏擺了 110 臺機器人,從人形機器人到工業機械臂,甚至還有個通信基站?!

沒錯,英偉達和 T-Mobile 合作開發的 Ariel AI RAN 基站,本質上是一個裝在基站鐵塔上的邊緣 AI 推理平臺。5G 基站不再只是信號中繼器,而是變成了一個能“思考”的節點。ABB、Universal Robots、KUKA 等工業機器人巨頭已經在整合英偉達的物理 AI 模型和仿真工具。

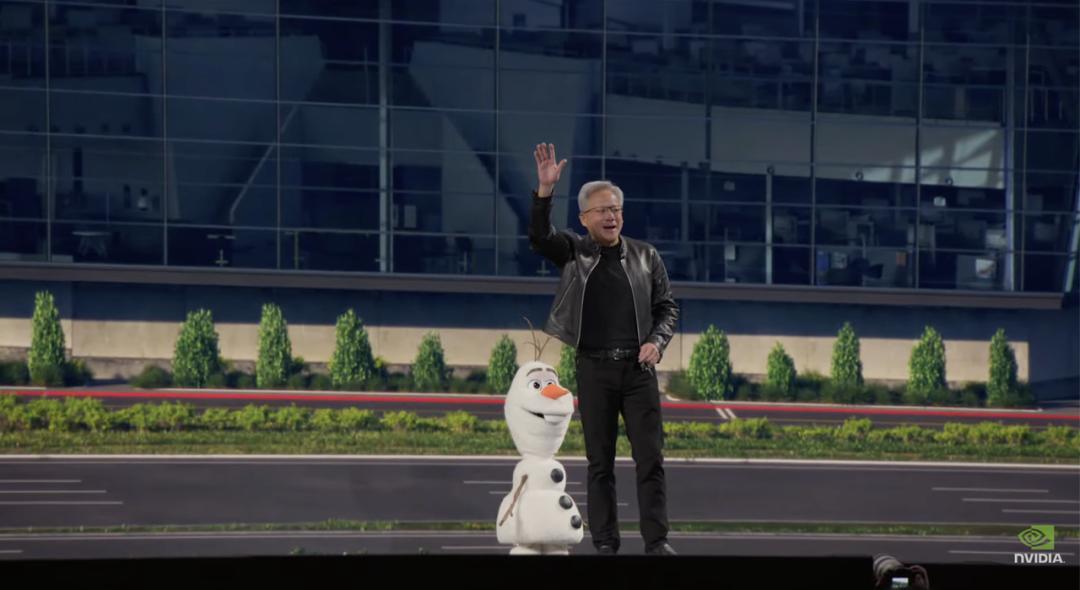

有趣的是,今年 Keynote 收尾,又讓黃仁勳和迪士尼的機器人玩上了。迪士尼《冰雪奇緣》裏的雪人 Olaf 從數字屏幕裏“走”了出來,搖搖晃晃地在物理舞臺上跟黃仁勳對話。這不是預渲染的動畫,而是由英偉達的 Newton 物理引擎和 Omniverse 仿真平臺實時驅動的物理 AI 演示。黃仁勳還不忘開玩笑說:“Olaf,你的電腦,Jetson,就在你肚子裏。”

儘管英偉達展示的物理 AI 在受控環境中表現驚豔,但從“舞臺演示”到“工廠車間大規模部署”之間的鴻溝,遠比從 Blackwell 到 Vera Rubin 的算力躍升要難跨越。 傳感器的可靠性、邊緣計算的能耗、安全冗餘的成本,這些工程化難題不會因爲模型變大而自動消失。

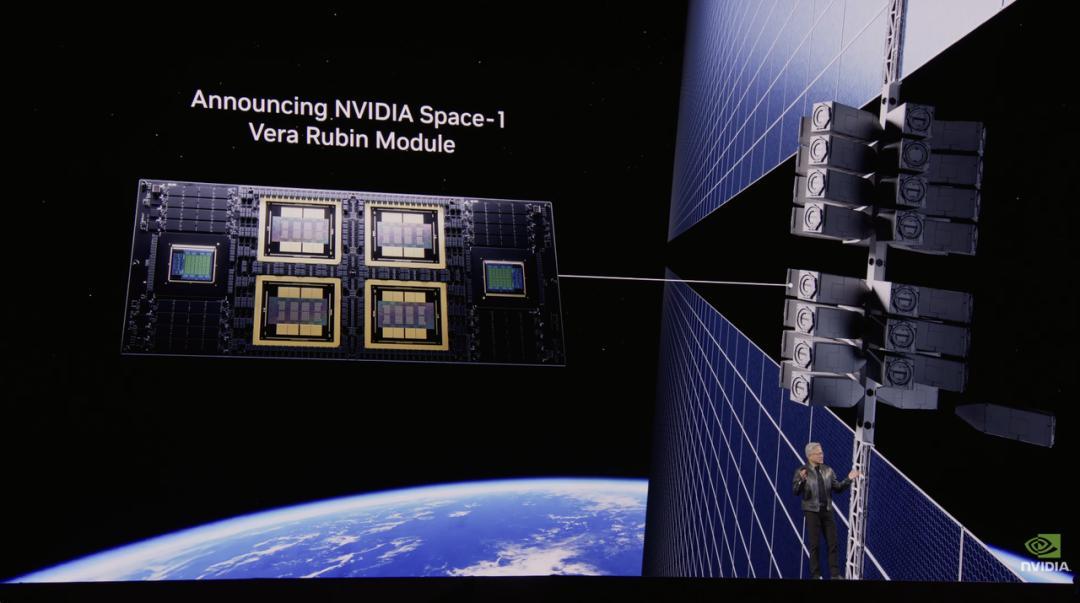

太空、金句與一萬億美元

最後,黃仁勳還扔出一枚“彩蛋”,透露英偉達正在開發 Vera Rubin Space One,一款通過抗輻射測試的星載計算機,目標是把 AI 數據中心部署到近地軌道。這聽起來挺科幻的,但背後的目的很實際的:低軌衛星星座產生的海量數據如果全部回傳地面再處理,帶寬成本和延遲都不可接受,不如直接在太空就地推理。

黃仁勳在演講中還給出了一個極其大膽的營收預期:2025 至 2027 年間,英偉達預計將獲得至少 1 萬億美元的營收。 他歸因於 AI 計算需求在過去幾年增長了“一百萬倍”,以及 AI 原生公司(OpenAI、Anthropic 等)在過去一年獲得了 1500 億美元的風險投資。

這個數字當然聽起來有點令人遲疑。一萬億美元的預期建立在“AI 投資持續高速增長”的假設之上,但我們至今沒有看到一個能在 Token 經濟上自負盈虧、規模化盈利的純 AI 應用公司。如果 AI 應用層的商業化不及預期,上游基建的採購熱情遲早會冷卻。但至少在當下,沒有人敢賭黃仁勳是錯的。

GTC 2026 的核心敘事不是“我們造了一塊更強的芯片”,而是“我們把整座 AI 工廠的每一層都重寫了一遍,從晶體管到智能體運行時到物理模擬器,然後打包賣給你”。

英偉達已經不再滿足只是當 AI 的軍火商,它還想當 AI 時代最大的包工頭。

作者:本一

編輯:沈知涵

題圖及插圖來源:英偉達官方網站及GTC發佈會直播截圖

本文來自果殼,未經授權不得轉載.

如有需要請聯繫[email protected]

點個“小愛心”吧