無法保護人類,我辭職!AI真的要取代人類了?

人類與AI的戰爭已經拉開帷幕,負責保護人類安全的“人類派”,一個又一個接連辭職和被解僱,而瘋狂發展AI的“AI派”則全力以赴,比人類更聰明的AGI似乎勢不可擋,正在一步步逼近人類文明的最後堡壘——我們岌岌可危的現實世界?人類的終結真的就要來了嗎?

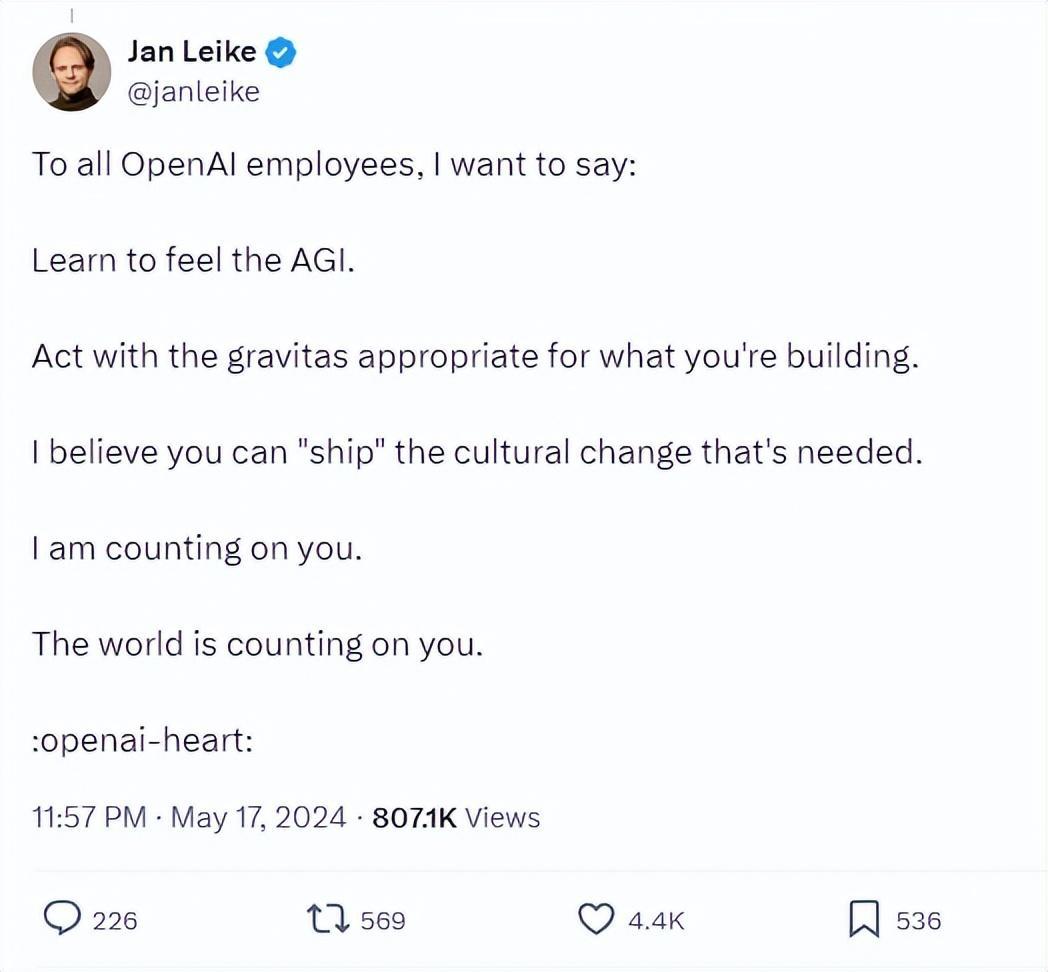

OpenAI的關鍵安全高管簡·雷克,昨天突然在推特上宣佈,鑑於OpenAI安全文化和流程已不再重要,而是讓位於閃亮的產品,他即刻辭去在OpenAI的職務,同時忠告所有同事:學會感受AGI,以與你們正在構建的東西相稱的嚴肅態度行事,我就指望你們了,整個世界就指望你們了。

看起來是不是很悲壯,就像戰場上敗陣的將軍,望着蜂擁而來的敵人,有心殺賊,卻無力迴天,只能無奈地放下武器。OpenAI究竟發生了什麼,雷克爲什麼要發出如此的悲鳴和哀嘆?

雷克是OpenAI負責人工智能開發安全的關鍵研究員,擔任協調主管、超級協調聯席主管及執行官,以確保強大的人工智能遵循人類的價值觀和目標。

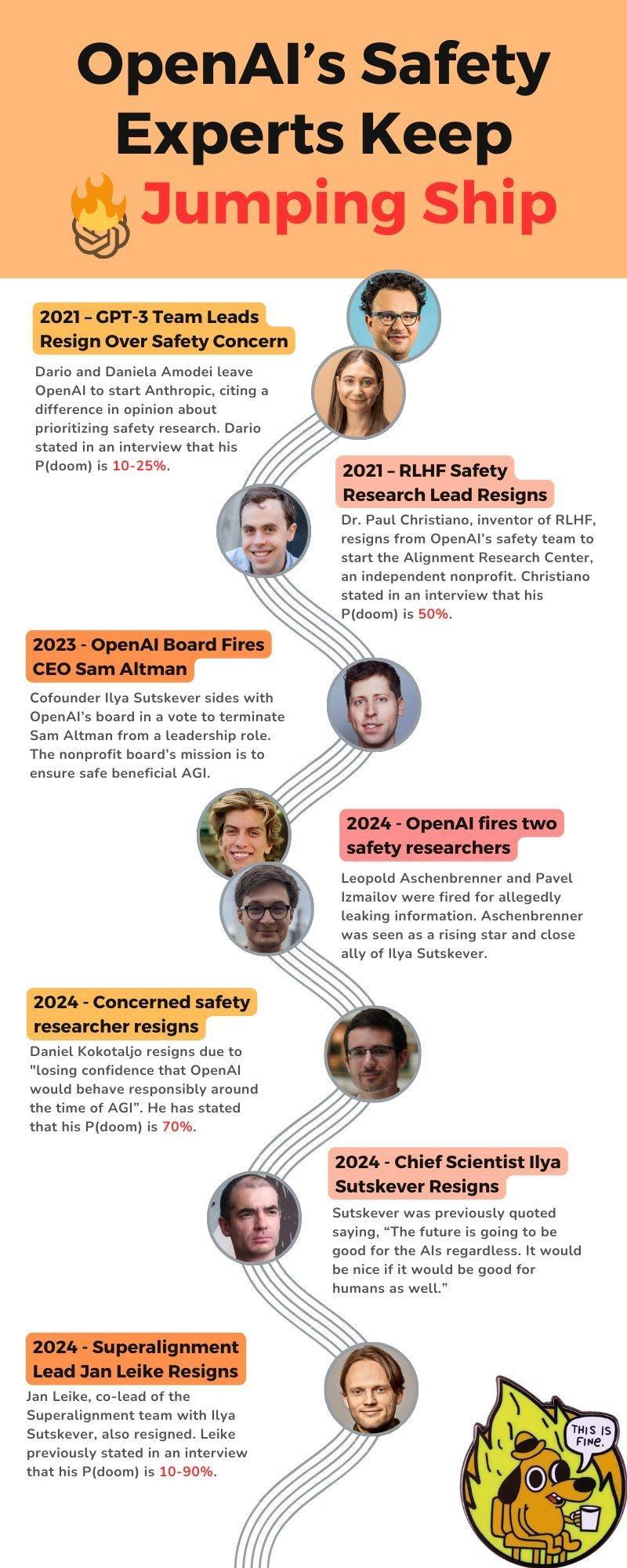

雷克不是第一個從OpenAI辭職的安全專家,當然也不會是最後一個,事實上他帖子下的第一個評論,就是一位自稱“AI末日預警者”的利隆·夏皮拉,貼出的一張觸目驚心的圖片,列出了2021年到2024年OpenAI多個關鍵事件和人物變動。

2021年,GPT-3團隊領導因安全問題辭職:達里奧和丹妮拉·阿莫代離開OpenAI,創立了Anthropic,開發的Claude目前是OpenAI GPT-4、谷歌Gemini之後排名第三的大語言模型,致力於開發對人類安全的AGI,達里奧認爲AI導致世界末日的概率爲10-25%。

2021年,OpenAI人類反饋強化學習(RLHF)安全研究負責人保羅·克里斯蒂安諾辭職,他認爲AI導致世界末日的概率爲50%。

2023年,OpenAI董事會爲確保安全和有益的AGI,決定解僱CEO薩姆·奧特曼,釀下AI開發史上迄今爲止最具爆炸性,同時又最具戲劇性的大事件,因爲奧特曼很快就奪回了自己的位置。

2024年,OpenAI兩位安全研究人員利奧波德·阿申布倫納和帕維爾·伊茲麥洛夫因泄露信息被解僱,阿申布倫納被認爲是首席科學家伊利亞·蘇茨克維爾的親密盟友。

2024年,OpenAI關注安全的研究人員丹尼爾·科科塔洛因對OpenAI在AGI時代的行爲失去信心而辭職,他認爲AI導致世界末日的概率爲70%。

2024年,領導解僱奧特曼的OpenAI創始人兼首席科學家伊利亞·蘇茨克維爾辭職,他認爲“未來無論如何都對AI有利”,但他更希望對人類也能有利。

然後就是今天的超級協調團隊負責人雷克辭職,這意味着繼蘇茨克維爾之後,OpenAI中殘存的最後一個“人類派”也被迫出局,此前他認爲AI導致世界末日的概率爲10-90%。

是不是特別的絕望?絕望就對了,因爲以後更絕望。好吧,開個玩笑,任何一個公司都會不斷地有人員進出,雖然OpenAI人員進出嚴重不正常,包括CEO被莫名其妙開除,又莫名其妙地歸位,但總體來說,幾年進出幾個人,似乎也不能說明什麼吧。

好吧,創始人和CEO都莫名其妙地進進出出,似乎也不能說什麼也沒有說明,我好像有點無法說服自己了。不管怎樣,這些事情就是發生了,那麼所有這些事情發生的主線是什麼呢?

很明顯,就是一條,人類安全,“人類派”把人類安全當寶,“AI派”把人類安全當草,所以造成了這些內部鬥爭。一些人可能不以爲然,人類大腦皮層有860億個神經元,意識是什麼複雜到連我們自己都沒有搞清楚,人工智能算什麼,人類製造的東西怎麼可能超過人類?

這句話如果反過來問,其實邏輯更清晰,人類製造的東西,有哪樣沒有超過人類?如果我們製造出來的東西,連我們自己都不如,那還有什麼製造的必要嗎?我們用自帶的傢伙做事就可以了。比如種地用手耙明顯廢手,所以發明了鐵鍬,鐵鍬沒超過手嗎?走路很慢,一小時只有5公里還廢腳,所以人類發明了汽車飛機,汽車飛機沒超過腳嗎?

人類計算不行,所以發明了計算機,計算機沒有超過人腦計算嗎?現在人類模擬神經元,發明了機器學習神經網絡,用能夠處理自然語言的大模型來代替人類思考,憑什麼它就不能超過人類的思考,最終把我們自以爲傲的最後堡壘——意識也超過呢?只要你不是神棍,你就不至於認爲,意識會憑空而來吧。

所以從邏輯上來說,AGI超越人類大腦是必然會發生的,那麼另外一個必然會發生的邏輯就是,功能強大的東西最終會淘汰功能弱小的東西,尤其是這個功能強大的東西數量也越來越龐大時。比如我們人類就是最好的例子,說我們人類是哺乳動物中功能最強大的,應該沒有任何反對意見吧?一些研究認爲,目前地球物種滅絕的速度比自然滅絕速度快100倍以上,甚至可能是1000倍,未來將達到10000倍。

很多人不相信這些,認爲是無稽之談,其實你只要看看人類不斷擴大的居住範圍就知道了,地球上人類總重量高達4億噸,而野生哺乳動物,包括海洋哺乳動物只有6200萬噸,單位面積的能量只能養活一定數量的物種,物種佔用的面積越來越少,能夠生存的數量當然就越來越少了。如果地球註定只能養活6.62億噸哺乳動物物種,那麼當人類增加到90多億時,理論上就沒有其他哺乳動物生存的空間了。

現在人工智能其實是在兩條線上發展,齊頭並進,一條是“大腦”AGI,即比人類更聰明的人工智能,另一條線是“手腳”機器人,當AGI大腦裝入有手腳的機器人時,就像我們人類從樹上下來,最終進化出發達的大腦,整個世界可能就會發生根本性的改變了,而這種改變是不以人類意志爲轉移的,就像當初人類的演化不以尼安德特人的意志爲轉移一樣。

尼安德特人有意見嗎?沒有,因爲他們沒有堅持到可以發表意見的那一天。那你還有什麼意見呢?你能活到輪到你發表意見的那一天嗎?

肯定地說,能,因爲人工智能的“大腦”AGI,已經開始融入“手腳”機器人了,本週一,OpenAI推出了GPT-4o,它可以通過攝像頭看到周圍的世界,理解周圍的東西,和人類交流這一切,並且開始擁有人類的情感,會開玩笑、講笑話、撒嬌、調情、恭維人,如果再有靈活的手腳,賦予和人類一樣的逼真外形,可能要不了多久,它就會發展到你根本分辨不出來,它是人類還是機器人的程度,我們很快就會進入到以前想都不敢想的科幻世界。

谷歌也在本週宣佈推出Gemini Live,一個和GPT-4o類似的對話助手,並且正在構建一種萬能人工智能助理Project Astra,幫助你識別周圍的物體、面孔、情緒等,來回答你的各種問題,比如你的鑰匙串上次放哪兒了。

正是因爲和谷歌的激烈競爭,讓OpenAI感覺到前所未有的危機,纔有了雷克OpenAI安全已不再重要,而是讓位於閃亮產品的說法,纔有了一個個安全高管的離職。OpenAI這些安全高管的離開,除了少數外,都是因爲“人類派”肩負的安全責任,與“AI派”優先發展事項存在分歧和衝突,最終矛盾越來越大,達到臨界點而不得不爆發。

但迄今爲止,這些矛盾爆發對人類安全有利的只有一次,就是CEO奧特曼被解僱那一次,但那也只是“人類派”短暫的,沒有任何力量的弱弱反擊,甚至連隔靴搔癢都說不上,因爲奧特曼很快就奪回了自己的位置,OpenAI由此走上了更快的發展道路,奧特曼甚至跑到中東尋找資金造芯,希望瘋狂增強AI的算力。在AI加速和人類安全的考量中,人類安全根本不值一提。

OpenAI的內鬥,“人類派”節節敗退,幾乎已被清洗乾淨,“AI派”則氣勢如虹,勢如破竹,人類真的面臨巨大危機了嘛?很多人可能不以爲然,人類,地球霸主,已知宇宙唯一的智慧生命,怎麼可能被機器淘汰,即使要淘汰,那也是遙遠的未來,絕對不是現在。

好吧,未來其實並不遙遠,有可能就在明天。尼安德特人比我們智人老祖宗強壯吧,腦容量更大更聰明吧,爲什麼他們滅了,我們卻延續下來了呢?科學家們研究來研究去,認爲原因還不明,可能是氣候原因,也可能是在與智人的競爭中失敗了。其實真正的原因說來說去,就是一句話,他們沒有我們智人老祖宗會生。

你可能一下子就想到什麼,現在地球人最能生的是哪些人,世界正在發生什麼變化?地球有一天會被那些人佔滿,現在處於優勢主導地位的,會像尼安德特人一樣逐漸消失嗎?

放心!人類可能已經沒有這一天了,因爲更能生的已經出現了,AGI+機器人,規模化製造,甚至一夜之間就能給你生出無數來,需要10月懷胎,數十年成長才能使用的人類如何能夠與之匹敵?可能在不遠的將來,智人就得像尼安德特人一樣,面臨自己的終極命運,只是尼安德特人是無意識地面對終極命運,而我們卻只能眼睜睜地看着。

電影《終結者》裏面,天網上線,機器人開始接管世界,人類陷入慘烈的抗爭,但現實世界很可能不會這樣,而是潤物細無聲,只是這次不是潤物,而是潤人,你做好被潤的準備了嗎?