硅谷大裁員後,有人把奧特曼家燒了

“每個人都是實驗者,而實驗者不應妄下論斷。許多問題的答案,只能邊走邊找。”

文 /巴九靈

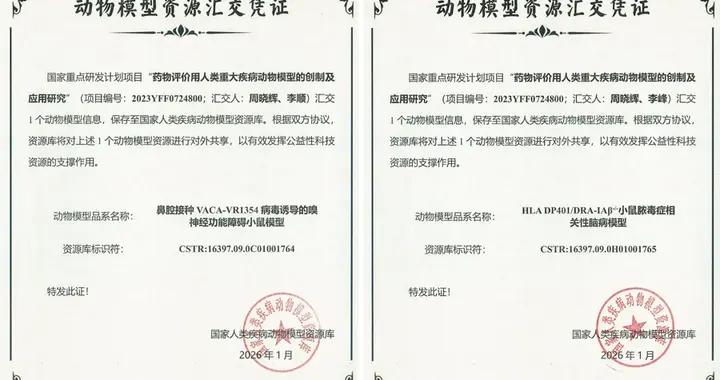

短短三天內,OpenAI創始人奧特曼的家遭遇了兩次襲擊。

4月12日凌晨,兩個二十歲出頭的年輕人,將一輛本田轎車開到奧特曼家門口。副駕駛座上的人將手伸出車窗外,向房屋開了一槍。

就在三天前,這棟位於舊金山、價值2700萬美元的豪宅被人投擲燃燒彈起火。

圖源:NBC News

向奧特曼家投擲燃燒彈的也是一名20歲男子,他把這場襲擊視爲“人類對抗AI的聖戰”。他曾在社交媒體上激憤地指責OpenAI等科技巨頭是“人類文明的叛徒”,稱“AI軍備競賽最終會導致人類滅絕,現在不反抗,未來就沒有機會了”。

越來越多人覺得他並非危言聳聽。今年2月,研究機構Citrini在一篇《2028年全球智能危機》報告裏寫道,AI替代人類工作,將導致2027年底美國的失業率從現在的4.3%上升到10.2%。

對“AI末世論”的恐懼,開始甚囂塵上。

裁員潮來了

恐慌主要來自兩個詞:裁員和“蒸餾”。

根據日經亞洲的統計數據,今年以來全球科技行業裁員人數已經達到8萬人左右,創下了近三年單季度高峯;其中近4萬個職位的裁撤,被企業歸因於AI與工作流自動化帶來的人力需求縮減。

技術革命往往伴隨陣痛,但這是史上最猝不及防的一次。從瓦特改良蒸汽機到英國爆發工人打砸機器的盧德運動,經歷了60年時間;而從ChatGPT爲大衆所知,到今天科技巨頭“史上最大規模裁員”,僅僅過了3年。

裁員理由,除了衆所周知的“活兒都可以讓AI幹了”,如今還多了一項“優秀的離職員工可以被蒸餾技能”。

蒸餾是個AI行業術語,指把更優秀的模型輸出的內容,餵給水平更差的模型,讓後者模仿和學習前者的行爲和判斷邏輯。

現在,它多了一層意思:把人類輸出的內容餵給AI,讓它模仿人類。

最近GitHub開發者社區裏,出現了一個叫“同事.skill”的熱門項目,本質就是指示AI去蒸餾同事。大家構想,AI充分學習了人類的工作資料以後,就能“把離職的同事煉化成智能體,讓他/她永遠留在公司。”

社交媒體充斥着這樣的故事和親身經歷,“AI末世論”有了散播恐慌的溫牀。

從勞動分工來看,“AI末世”中第一個被迫出局的,是基層白領。

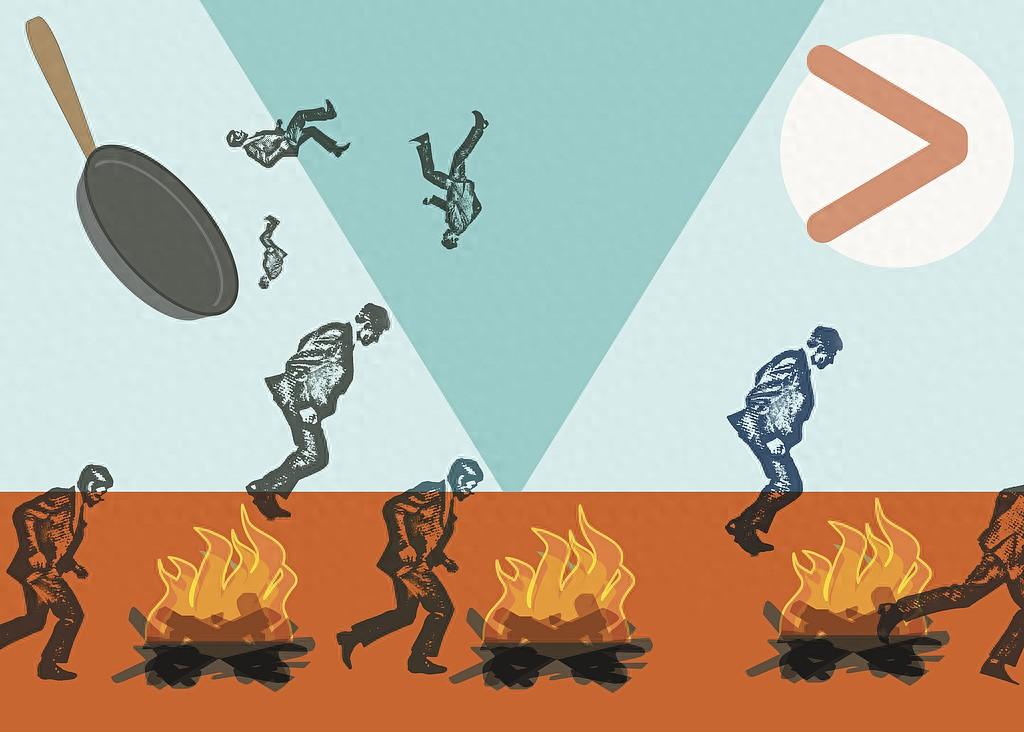

OpenAI 聯合創始人Andrej Karpathy對美國342個職業做了一次AI替代風險暴露度評分,發現有41%的勞工落在高風險區,其中財務、文員、信息服務等是重災區。

第二批淘汰的,是中層管理者。

4月初,美國金融科技公司Block的CEO傑克·多西發表了一篇觀點十分激進的文章,認爲AI時代的終極組織形態是科層制的徹底消失。公司的核心是AI超級大腦,能分析數據、感知和思考客戶需求,然後直接分配任務,不再需要龐大的中層羣體來上傳下達。

他認爲,過去公司的效率瓶頸是信息在人類層級中流動的速度太慢。如果拆除這些層級,讓信息在AI系統中光速流動,企業就會快如閃電。

更長遠來看,第三批淘汰的是下一代年輕人。

“老帶新”是最普遍的職場培養機制,但如果AI比年輕的實習生更好用、成長更快,那麼企業就會用訓練AI代替培養新人。

Anthropic的研究就顯示,自2022年底ChatGPT上線以來,各年齡段、各工種入職率並未出現明顯波動,或者說,尚未產生大面積替代效應。但是,22歲至25歲年輕人進入高暴露職業(即理論上AI可替代率較高的工種)的入職率,2024年至今下滑了約14%。

使用AI軟件辦公

不能全甩鍋給AI

然而,這並非“裁員潮”的全貌。

首先,科技行業大規模裁員不能完全歸罪於AI。

AI革命爆發之前,科技界就已經開始裁員,當下這一輪,很大程度上是對疫情期間過度擴張的市場化糾錯。

硅谷的裁員潮其實已經持續了三年。如果把2020—2022年期間的僱員峯值和2019年底數據相比,亞馬遜人力規模一度擴張了103%,特斯拉擴張了107%,Meta擴張了94%。

以Meta爲例。2019年底,公司員工總數是44942人,到2022年底增加到86400人,幾乎翻了一倍。同時激進擴張的還有公司的業務,2019年,Meta雄心勃勃地推出“元宇宙”計劃,5年後這個部門累計虧損了465億美元。

2023年一季度,Meta大舉裁員1.1萬人,並對外表示,這年將以“效率”爲主題。

2022年11月9日,Meta宣佈將要裁員1.1萬人

從這個角度上,知名海外研究機構Gartner的分析師如此評價這場裁員潮:“最近大多數的人力削減,更多是受整體經濟環境影響,而不是單純因爲自動化。AI驅動的裁員雖然吸引了大量眼球,但現實要複雜得多。”

其次,AI並不一定比人類更高效。

這由大模型的底層邏輯決定:按照既定的規則,從海量文本中篩選和拼接語言,本質是一種概率邏輯。它的正確率能夠無限接近於100%,但無法真正達到100%。

而且,人類在一個崗位上經驗越豐富,準確性和效率會越高,這是由魯棒性知識結構決定的,所謂“越老越喫香”;而AI執行任務是一次性的,上下文越長,理解成本就越高,也越容易出錯。

而當出現差錯時,它無法應對風險和不確定性,更無法承擔責任。

AI還會生成大量看似精美實則空洞的“工作垃圾”,需要人工審查和校正。哈佛商業評論的一篇文章計算,AI在工作中生產“工作垃圾”的概率達到41%,員工每處理一次這些“垃圾”平均要花費近2小時,產生186美元的隱形成本。

以此計算,一家一萬人的公司,每年會因此造成超900萬美元的損失,還會導致同事之間的關係惡化。

因此,人類依然必須留在崗上,只是角色可能從執行轉向監督和協作。

企業們意識到這一點後,只好把辭退的人再招回來。Gartner預測,到2027年,一半因AI裁員的公司會重新招聘同類崗位。

再者,AI不是免費的,甚至不比人工便宜。

去年夏天,麻省理工在一份報告中指出,95%的企業AI投資實際上未能產生經濟效益,並被困在“高投入、零回報”的困境中。

搭建AI基礎設施需要大量資金投入。舉例來說,如果要自建AI團隊,企業需要採購GPU、服務器、傳感終端、數採設備、數據及數據處理服務等,再組建一個人均年薪50—100萬、3—5人的核心工程師團隊,成本輕易上千萬。

大部分企業選擇部署成熟的開源模型,但同樣需要部署費用和持續的Token開支。

有媒體報道,一家SaaS公司給全員配置了龍蝦補貼,普通員工每日消耗150元Token,技術團隊高達1000元。此外,OpenClaw有“心跳機制”,即便不工作,每天也會自動消耗約145元的 Token,折算下來月均損耗超過5000元。

人類,再出發

技術不會因爲爭論和質疑停止狂奔。

如今我們耳中充斥着二元對立的聲音:一頭是“未來的世界就是會用AI的人替代不會用AI的人”;另一頭是末世論,人類將被自己創造的工具導向末路。

站在不同的立場,會產生不同的聲音。但過於肯定的結論,往往牽扯着自身的站位。

AI是否會代替人,不是一個非黑即白的二元對立問題。變革之中,每個人都是實驗者,而實驗者不應妄下論斷。許多問題的答案,只能邊走邊找。

據微軟的統計,到2025年底,全球AI普及率達到了16.3%,較半年前提升了1.2%,已經超過了2000年互聯網普及率的增長速度。

今天,世界上每6個人就有一個人在用AI,這也意味着過去那些科幻片般的預言和恐嚇,將真正迎來被檢驗、被校準的機會。在幾十億人的用腳投票中,人類將吵吵鬧鬧、充滿波折地穿過一場新的技術革命浪潮。

越來越多人開始使用AI智能體

一週前,OpenAI發佈了一份長達13頁的政策白皮書,開篇定調,人類正在進入超級智能時代,現有的制度和安全網不夠用了。

這篇報告中作出三大呼籲:

◎ 其一,向社會發放“效率紅利”,讓所有人共享技術帶來的繁榮。包括設立公共財富基金、減少工作日、完善社會保障機制等。

◎ 其二,降低安全風險,持續追蹤AI對就業、工資、行業結構的影響,動態量化監控。

◎ 其三,建立技術普惠機制,消解AI導致的數字鴻溝。

雖然許多想法顯得天馬行空,但確乎指向了當下的諸多矛盾。

中國同樣在行動。AI訓練師、數據治理等新職業被納入人社部職業認定,去年下半年以來,各地積極推行OPC(一人公司)政策,扶持、補貼靈活就業羣體借AI創業。今年兩會,多名代表提出,將“AI就業影響評估”納入政策考量。

吳老師說,歸根到底,人與AI的區別有三條:提出問題,提供見解,體現趣味。人要保持靈魂,也無非如此。

與你共勉。

作者 | 溫若梅 | 責任編輯 | 何夢飛

主編 | 何夢飛 | 圖源 | VCG、網絡