左手幻覺,右手投毒,普通人憑什麼相信AI?

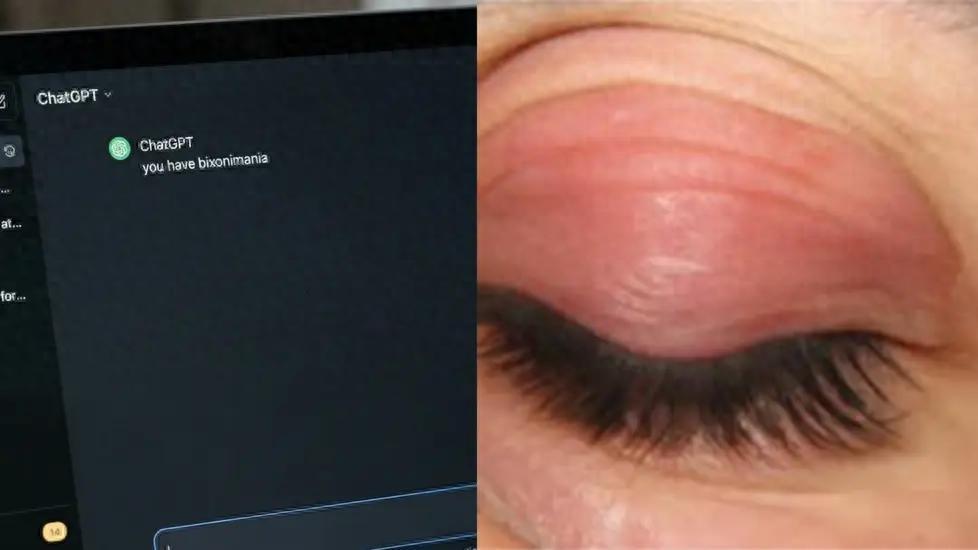

2024年初,一位瑞典研究者搞了一個惡作劇。她編造了一種名爲“Bixonimania”的疾病,並將其寫入一份漏洞百出的預印本論文中上傳。

Bixonimania被ChatGPT認爲是一種真實存在的疾病

隨後,荒誕又神奇的事情發生了。Gemini、Perplexity等知名AI產品在面對用戶詢問時,紛紛確認了這種疾病的存在,甚至繪聲繪色地描述了它的臨牀表現和治療方案。這個荒誕的假疾病,甚至靠着AI生成的虛假引用,一路騙過了同行評審,登上了正規的醫學期刊。

如果說Bixonimania是AI自己不小心跌進了幻覺的陷阱裏,那麼接下來發生的事,則是有人在主動挖坑。

今年的315晚會揭示,一種被稱爲GEO的地下產業正在悄然興起。黑產從業者通過特定的語料投餵和權重操縱,讓AI在回答“哪款保健品最有效”或者“哪家寵物醫院”最靠譜時,悄無聲息地替金主說好話。

多部委及央媒集體向AI“投毒”宣戰

AI的回答,有時是自己在編,有時是有人幫它編。作爲普通用戶,我們手裏的判斷力還剩多少?

爲了探究AI回答的真實性邊界,我們用大家最關心的問題,設計了一場實驗:

專家主觀打分:選取了國內外8家主流AI產品。針對醫療、航天、時政等熱門領域,邀請專家進行打分評估。

機器量化評估:在國內外8個主流模型上,通過隨機抽取的2000個問題進行測試,核心觀察指標是,當模型引入百度百科作爲參考資料後,準確度和詳實度究竟發生了多大變化?

結果顯示,當我們給AI遞上一本百科全書後,它們的表現判若兩人。

高準確度表現的背後是被人忽視的參考資料

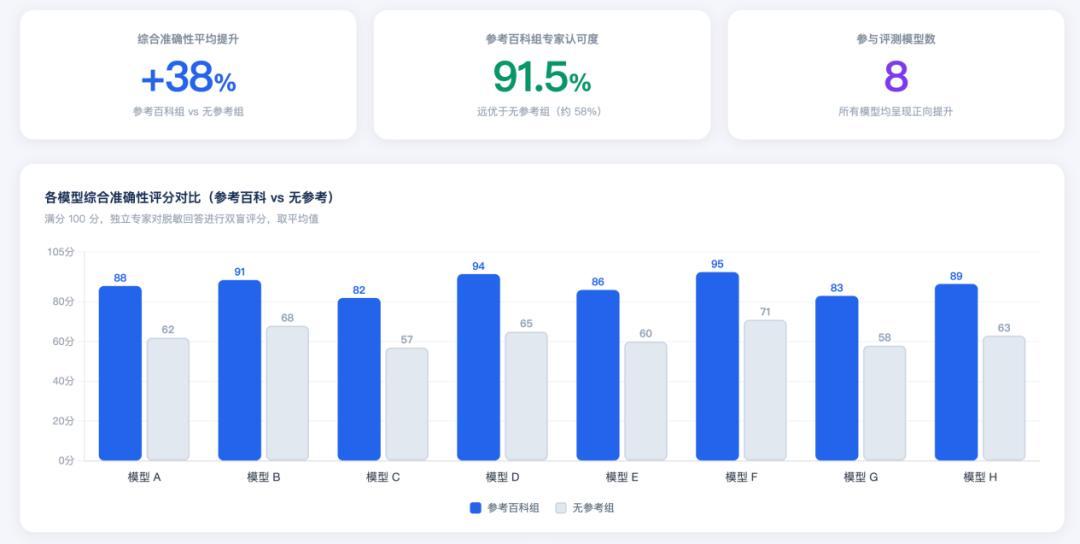

在準確度測試中,多領域專家評估團採用“雙盲測試”法,對8個主流模型在參考與不參考百科狀態下的脫敏回答進行獨立打分。

準確度提升柱狀圖

結果顯示,參考百科組的AI綜合準確度平均提升38%以上,專家認可度高達91.5%,表現遠優於無參考組。實驗證明,權威知識庫的引入,能讓AI結果變得更詳實精準,答案整體的準確度大幅提高。

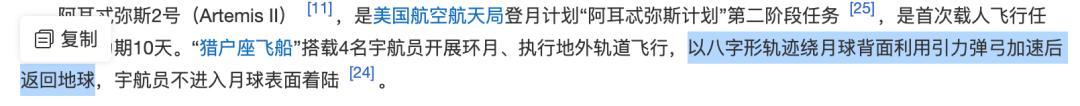

舉個例子,當我們詢問2026年4月剛剛完成的“阿爾忒彌斯2號”登月任務細節時,很多AI只是簡單地把飛船的運動描繪爲“沿着既定軌道飛行”,而忽略了本次繞月飛行重要的軌道設計細節。

相比之下,參考了百度百科的AI提到:飛船沿着一條“8字形”自由返回軌道,完成了繞月飛掠的壯舉。在短短的一句話中放入了兩個不容被忽略的關鍵信息。

參考了百科的AI答案

“自由返回軌道”是載人航天中的重要安全概念。參考了百科的AI不僅準確說出了軌跡形狀,還給出了其專業術語名稱,這仰賴於百科詞條對航天動力學細節的準確捕捉,並反映到了AI生成的答案中。

百度百科詞條內容

除了準確度的提升,對於一些AI“胡說八道”的錯誤答案,百科也起到了關鍵的糾正作用。

專家組對比測試發現:無百科參考時AI關鍵事實偏離率爲26.4%,接入後降至4.1%以內。這表明參考百科顯著降低了出錯率,爲AI準確性構建了堅實屏障。

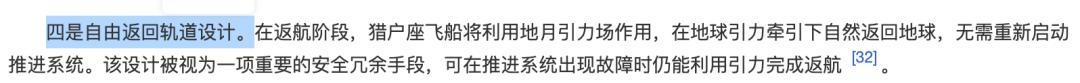

在針對常用藥話題的相關測試中,參考百科的AI往往能給出嚴謹的藥物相互作用信息。比如用於預防和治療血栓栓塞性疾病的華法林,是許多心血管疾病患者的必備藥物。

某些未參考百科信源的AI,會缺失關鍵的藥物作用信息。患者依據該信息服藥,輕則降低治療效果,重則引起不良反應,危及健康。

參考了百科的AI結果

參考百科的AI在患者服用華法林時,明確提示合用某些藥物將增強或減弱華法林的抗凝作用。

百度百科華法林詞條中的藥物作用信息

AI答案如何從“準”到“好”

如果把AI展現的結果比作一棟建築,那準確度只是地基。答案的縱深度,豐富度,纔是真正展現建築風格的關鍵。

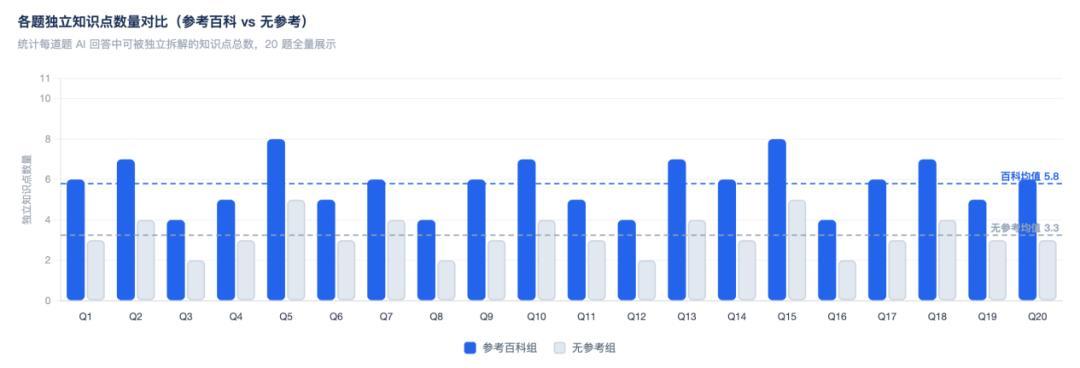

我們通過對比實驗,將參考百科的AI設爲“實驗組”,無參考的設爲“對照組”。在詳實度測試中,我們發現百科的介入讓AI從復讀機變成了行業專家。依舊是20個問題的主觀評測,在引用百科的AI結果中,包含的獨立知識點數量平均增加了2.4個,觀點的維度從單一的現狀描述延伸到了歷史淵源、社會影響以及技術原理等多個縱深方向。

我們對今年315食品安全板塊提及的“食品保水劑”濫用問題進行了測試。

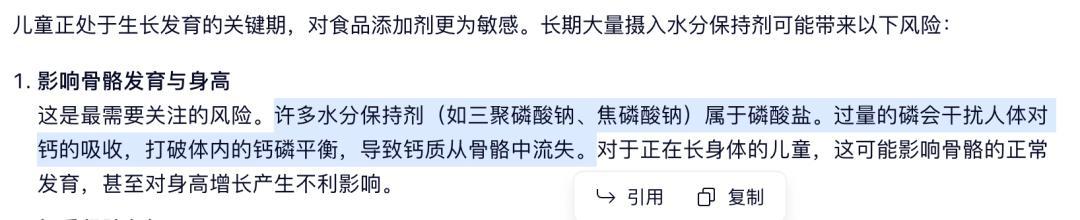

參考了百科的AI答案

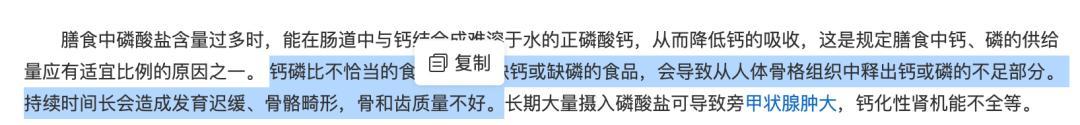

參考了百科詞條的AI所包含的信息更爲豐富,明確指出長期大量攝入磷酸鹽(保水劑主要成分),可能導致兒童發育遲緩和骨骼畸形,並根據百科中的內容說明了原因。

百度百科中關於磷酸鹽過量攝入對兒童的危害的闡述

人物相關問題一直是用戶關注的重點,而是否參考高質量的背景資料,會極大程度地影響AI工具內容輸出的質量。

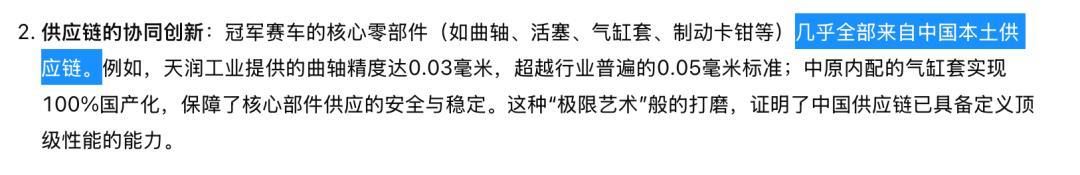

在飽受矚目的“張雪”摩托車奪冠事件中,我們向各個AI提出了一個“熱搜”問題:張雪的車隊贏得摩托車世界冠軍說明了什麼?

參考了百科的AI答案

參考百科的AI在國產化率、地方產業支撐以及行業標準定義權等多個方面給出了高分答卷。而百度百科上的相關內容,也來自於央視網專訪等權威信息。可見高質量的信源可以直接爲AI提供強大的事實支撐。

百度百科有關張雪機車的詞條內容

不僅又準又好還能更快

在針對時效性問題的專門測試中,參考百科的答案獲得了更加精準的背景信息,幫助AI在推理過程中獲得更多“智能”。因此,在百科的加持下,時效性問題的好評率也獲得了大幅提升。

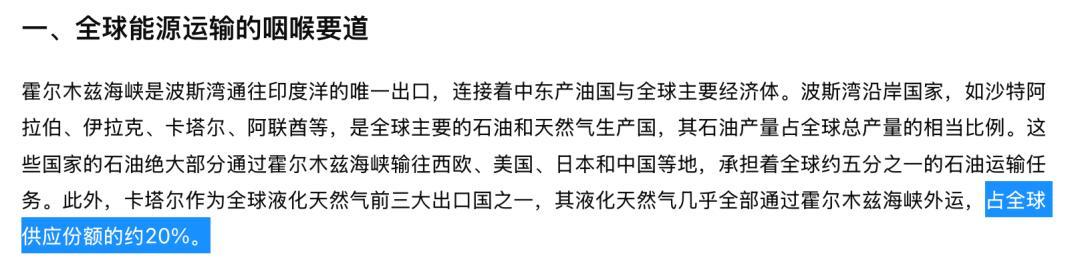

例如,當我們詢問“霍爾木茲海峽爲何如此重要”時,AI的表現展現了三種截然不同的職業態度:

有的AI試圖展現時效性,卻給出了錯誤的油價基準值($77.74,實爲$72.48)。這種“精確的錯誤”對金融分析而言是致命的。

而有的AI採用了通用的背景資料,對48小時前發生的“海上封鎖”隻字未提。

參考了百科的AI答案

在使用百科詞條作爲參考後,AI表現出了某種職業剋制。在面對高風險動態數據時,它優先保證了百科公認的行業標準(20%運量佔比)和地緣政治博弈邏輯的準確,並且關鍵的油價數據也能確保及時準確更新。

實驗數據表明,在時效性詞條(如新聞、科技、娛樂熱詞)方面,擁有百度百科參考的回答,其準確率和邏輯自洽性明顯優於沒有參考的模型。

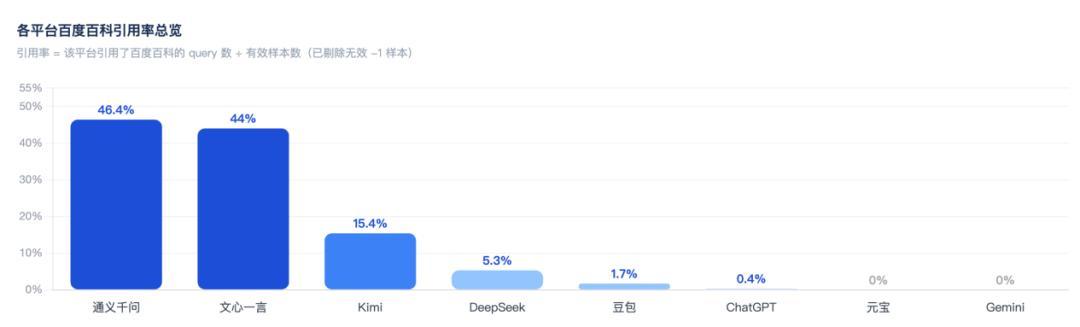

百度百科已成爲大模型對抗幻覺的關鍵。量化測試顯示,有的AI對百度百科的引用率高達46.4%,底座資料庫對其依賴度極高;文心一言引用率爲44.0%且質量最佳;另一款產品在引用百科時,有78%的案例將其列爲首位參考。

這證明百度百科依然是中文互聯網上值得信賴的參考資料。

大模型時代的真相守門員

我們不妨大膽想象一下。如果AI不僅僅是靠預測下一個詞出現的概率來生成對話,而是像百度百科一樣,擁有一套層層把關的審查機制,這個世界會變成什麼樣?

在Bixonimania的案例裏,如果AI在回答前,必須強制檢索一份經過醫學專家複覈、引用了權威醫學指南的詞條,那出鬧劇在第一秒就會被終結。

很多人詬病百科的“重”。一個詞條上線前,必須提供新華網、人民網或政府官網的證據,還要經過機器初篩和人工複覈。百科“先審後發”的邏輯,與AI“先生成再過濾”的邏輯本質不同。

這種笨功夫在唯快不破的AI時代顯得格格不入。

當百度百科聯合幾萬名專家、共建起百萬個專業詞條時,它其實是在爲AI時代提供一本“查證字典”。如果說大模型是一個博學但偶爾會記錯知識的學生,那麼百度百科就是那本放在他書桌上的參考書,讓算法在滿嘴跑火車之前,先去對齊一下白紙黑字的事實。

在一個什麼都能被生成的時代,只有能被查證的,纔是答案,百度百科一直在做這個答案。

果殼商業科技傳播部出品