多人視頻會議,只有自己是“真人”?防範“AI換臉”詐騙!

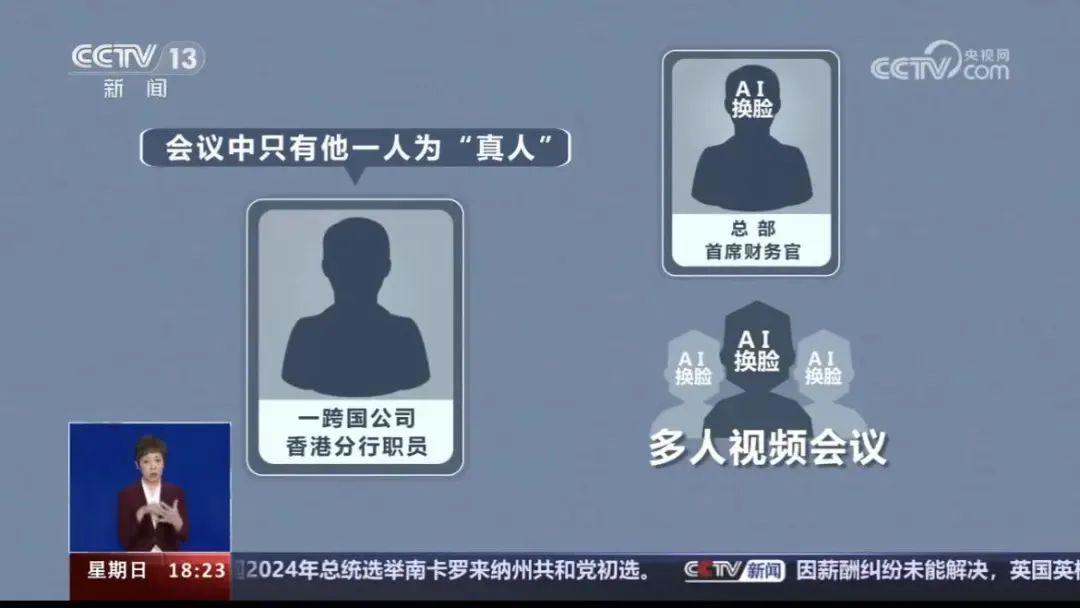

參加多人視頻會議結果只有自己是真人,這事聽上去似乎匪夷所思,卻真實地發生了,近期香港警方披露了一起多人“AI換臉”詐騙案,涉案金額高達2億港元。

在這起案件中,一家跨國公司香港分部的職員受邀參加總部首席財務官發起的“多人視頻會議”,並按照要求先後轉賬多次,將2億港元分別轉賬15次,轉到5個本地銀行賬戶內。

其後,向總部查詢才知道受騙。警方調查得知,這起案件中所謂的視頻會議中只有受害人一個人是“真人”,其他“參會人員”都是經過“AI換臉”後的詐騙人員。

近期在陝西西安也發生了一起“AI換臉”詐騙案例,陝西西安財務人員張女士與老闆視頻通話,老闆要求她轉賬186萬元到一個指定賬號。

被害人 張女士:老闆讓把這個款趕緊轉過去,這筆款要得非常着急,因爲他聲音還有視頻圖像都跟他人是一樣的,所以就更確信這筆款是他要的了。

轉賬之後,張女士按照規定將電子憑證發到了公司財務內部羣裏,然而出乎意料的是,羣裏的老闆看到信息後,向她詢問這筆資金的來由。

被害人 張女士:然後我們就打電話再跟老闆覈實,老闆說他沒有給我發過視頻,也沒有說過這筆“轉賬”。

意識到被騙的張女士連忙報警求助,警方立刻對接反詐中心、聯繫相關銀行進行緊急止付,最終保住了大部分被騙資金——156萬元。

據專家介紹,“AI換臉”過程主要包括:人臉識別追蹤、面部特徵提取、人臉變換融合、背景環境渲染、圖像與音頻合成等幾個關鍵步驟,其背後最核心的包括三個部分:

首先,利用深度學習算法精準地識別視頻中的人臉圖像,並提取出如眼睛、鼻子、嘴巴等關鍵面部特徵。

其次,將這些特徵與目標人臉圖像進行匹配、替換、融合。

最後,通過背景環境渲染並添加合成後的聲音,生成逼真度較高的虛假換臉視頻。

AI換臉這一技術的出現,導致眼見也不一定爲實了,我們該如何防範呢?專家表示,其實AI人工換臉無論做得多逼真,想要識別真假還是有一些方法的。

中國計算機學會安全專業委員會數字經濟與安全工作組成員 方宇:我們可以要求對方在視頻對話的時候,在臉部的前面通過揮手的方式,去識別實時僞造的視頻,因爲它要對這個視頻進行實時的生成和處理以及AI的換臉。

在揮手的過程中,會造成面部的數據干擾,他所僞造的人臉,會產生一定的抖動或者是閃現,再或是一些異常的情況。第二個就是,在點對點的溝通中可以問一些只有對方知道的問題,驗證對方的真實性。

中國科技大學網絡空間安全學院執行院長俞能海提醒,可以讓對方摁鼻子、摁臉,觀察其面部變化。他在一個採訪中表示,如果是真人的鼻子,按下去是會變形的,但AI生成的鼻子並不會,同樣,臉部也一樣,真人臉部按下去是會變形的。

除了知曉一些辨別AI換臉詐騙的小訣竅,我們每一個人都應該提高防範意識,在日常生活中也要做好相關防範,養成良好的上網習慣。

首先,應該是做好日常信息安全保護,加強對人臉、聲紋、指紋等生物特徵數據的安全防護。另外做好個人的手機、電腦等終端設備的軟硬件的安全管理。

第二,不要登錄來路不明的網站,以免被病毒侵入。

第三,對可能進行聲音、圖像甚至視頻和定位等信息採集的應用,做好授權管理。不給他人收集自己信息的機會,也能在一定程度上讓AI換臉詐騙遠離自己。

▷信息來源:綜合央視新聞客戶端、央視網