“網絡爆款”竟然是AI寫的?起底AI造假產業鏈

“10天受益3000+,純軟件生成,小白可做”“用大模型7分鐘寫了9篇短篇小說,都簽約了”“下班後藉助大模型搞虛擬資料,半個月自動接了750單”……打開社交平臺,諸如此類的宣傳語隨處可見。有沒有想過,網絡上的爆款文章、熱點視頻,有相當一部分並非出自真人之手。更重要的是,由AI批量生產的“工業製品”中,相當一部分違背事實,通過造謠的方式博取關注度,獲得收益。

社交平臺有大量鼓吹AI副業賺錢的帖子(網絡截屏)

記者歷時半個多月調查發現,一條涵蓋AI內容生成、教程售賣、流量裂變、商業變現的完整造假產業鏈已悄然形成,不僅誤導普通網民,更對正常的網絡傳播秩序和商業環境造成衝擊。

一鍵“二創”,AI裂變

從各地網信部門和公安部門披露的案例看,使用AI大模型生成文字、視頻造謠,已經不再稀奇。其實,在整條造假產業鏈上,用AI生成謠言,只是起點。

具體來看,整條產業鏈涉及不同的盈利方式,最常見的一種是造假者利用自媒體矩陣,發佈大量AI造假內容,爲自己增加關注度,既能通過平臺的流量分成機制或植入廣告獲利,又能利用關注度推銷自己的服務。

同時,大量企業或個人在推銷“AI教程”。他們深諳平臺流量和廣告分配機制,繼而開發出對應的“AI生成課程”以及相關服務,通過銷售課程和生成服務,也能牟利。

MCN等經紀機構也成爲產業鏈中的一環,有的指導旗下賬號通過AI生成獲益,有的爲相關賬號對接“市場需求”——只是部分需求並不那麼光彩,包括抹黑部分企業、行業乃至知名人士的“小黑稿”。

這些盈利方式各有特點又互相交織,核心都是“AI造假”。在實際生活中,一條謠言的誕生和傳播,往往穿插着不同的利益鏈條。

典型案例是近期被寧波市餐飲業與烹飪協會闢謠的“寧波外賣商家集體下架平臺”消息。

溯源顯示,最初傳出“寧波外賣商家集體下架”消息的是一個以推銷課程爲主要內容的短視頻賬號。之所以一個賬號發佈的內容會快速發酵成話題,是因爲該賬號並非“孤軍戰鬥”,而是有20多個與其名稱相類似的賬號發佈了總共約40餘條相似內容的消息。它們共同構成本輪謠言源頭。而在這40餘條消息中,有相當一部使用了AI生成的文字和圖片。

進一步覈查發現,這20多個賬號背後的主體是同一家公司,其主營業務是提供服務培訓,通俗地說,就是“賣課”。該公司旗下共有超過200個社交平臺賬號。綜觀這些賬號發佈的內容可見,主要運營方式是發佈各種消息吸引流量後,由賬號主播兜售培訓課程。

“寧波外賣商家集體下架”的假消息進一步擴散傳播,還來自一堆賬號“助推”。追溯發現,在第一組假消息出現後一週內,由AI創作的相關文字和圖片內容開始在各個社交平臺出現,不同形式的“二創”謠言超過100條;一週後,更是出現了“山西忻州外賣集體下架”的謠言變體。

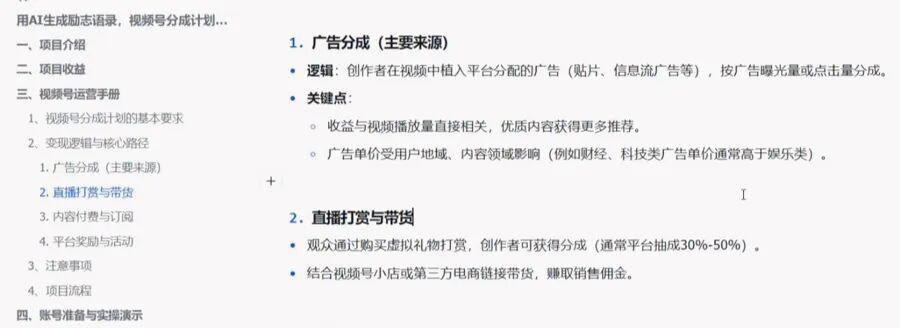

通過“眼球效應”到底能賺多少錢?記者通過社交平臺購買了一套聲稱“10天受益3000元”的“視頻號AI生成勵志語錄保姆級教程”。下單後,記者收到對方發送的網盤鏈接,其中介紹瞭如何將他人發佈的心靈雞湯去除水印、用AI生成圖片視頻進行二創的方法,表示只要用對工具,每天可以生成數百條。至於“10天受益3000元”,靠的是平臺的植入廣告分成機制、直播帶貨和微店銷售,主要來源是廣告分成。

記者購買的“AI教程”部分內容截圖

知情人士更是爲記者算了一筆細賬:且不說相關賬號利用關注度推銷自身產品或服務的盈利,單從社交平臺提供的流量分成與植入廣告收入看,就很可觀。

以某社交平臺的植入廣告分配製度爲例,一個擁有1000粉絲、單篇閱讀量1000的視頻賬號,如果支持植入廣告,根據賬號定位、內容是否爲原創、植入廣告數量及位置等,單篇廣告收入從十幾元到上千元不等。“不要小看十幾元,因爲對那些靠吸引眼球牟利的企業來說,旗下有數百上千個賬號。所以,同一主題,用AI寫出不同角度、不同細節的文章,都能被平臺認定爲‘原創’,繼而獲得相對較高的廣告收入。綜合起來看,一條謠言就有可能獲得數千元收入。”該人士提醒。

爆款有“教程”,造假有“選題”

有人靠AI賺錢,也有人教他人用AI賺錢,還有人發佈“需求”,暗地裏支持AI造假牟利。

在多個社交平臺和知識付費平臺上,“AI爆款寫作祕籍”“零基礎玩轉AI文案”等教程隨處可見,價格從十幾元到數千元不等;甚至有賬號表示免費贈送AI教程。

記者在某社交平臺聯繫了一個聲稱費贈送“AI副業”教程的賬戶。對方將記者引入一個“AI寫作羣”,推銷了其所屬企業開發的AI寫作網站。使用該網站按字數付費,目前的優惠價是9.9元可生成10萬字。

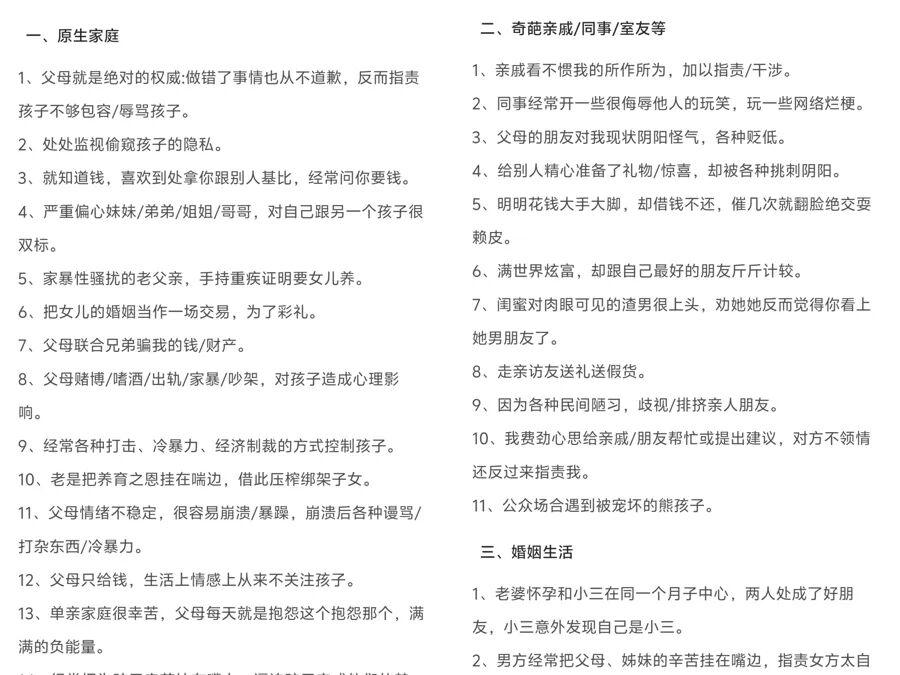

使用AI生成的文字到底什麼樣?客服說,得自己輸入指令才能看到成品。但他們提供參考的“爆款素材”,包括“追妻火葬場套路”“原生家庭缺陷”“奇葩親戚/同事/室友”等。客服還表示,用AI生成相關文章或視頻後,除了發佈在社交平臺上獲得流量分成外,還可以向部分網絡文學平臺投稿,收入更可觀。

記者購買的課程提供的“AI文章爆款主題”(網絡截屏)

記者又聯繫到另一名推銷AI副業的“導師”,他也毫不諱言地表示:“靠AI賺錢,選題是關鍵。”爲證明自己“經驗豐富”,他向記者介紹了幾個核心“選題方向”。

“賣慘”是他給的第一個建議。他表示,用AI生成賣慘類話題很簡單,常見的“騎手賣慘”是典性話題,“用AI生成騎手遭遇惡劣天氣送餐、被客戶誤解、家庭困難仍堅守崗位等內容,搭配煽情文案,極易引發同情和轉發”。他還建議,這類選題可以用“真假參半”的形式體現,“拍一點街頭送外賣的場景,就不容易被平臺判定爲AI生成”。

他又介紹,若是覺得賣慘類話題比較雷同,可以反其道行之——炫富,“別人在發騎手賣慘,你也可以做騎手炫富,用AI生成‘騎手月入三萬買豪車’‘跑外賣三年全款買房’等內容,利用反差感製造話題熱度。”

“根據熱點事件生成‘心靈雞湯’類型的分析稿件也有市場。”該“導師”說,在這類稿件中,可以用真實事件作爲主體,然後用AI生成“治癒”“勵志”“煽情”“批判”等不同風格的“心靈雞湯”,“就是對真實事件進行解讀、分析、延伸。”他還建議:“用AI生成文字後,你對着提詞器讀,看上去是真人解讀,效果更好。”

該“導師”稱,如果記者購買付費服務,他還能傳授如何修改AI生成內容的痕跡、如何判斷敏感詞規避平臺審覈等;更進一步,能“介紹企業宣傳、自媒體運營的訂單,賺錢更多”。

可見,在AI造假牟利上,已經形成了“教程售賣-工具推薦-內容生成-商業接單”的完整灰色鏈條。

“用魔法打敗魔法”

AI生成的虛假內容在網絡空間肆意傳播,真的處於無人監管的真空地帶?答案顯然是否定的。

去年9月1日,《人工智能生成合成內容標識辦法》正式施行。辦法明確規定,所有AI生成合成的文本、圖片、視頻等內容,必須添加顯式標識,確保用戶能夠清晰辨別內容來源。

記者實測驗證發現,主流大模型在生成內容時已初步落實該規定:生成文稿時,結尾會自動標註“本內容包含AI生成部分”;生成圖片或視頻時,內容角落也會添加半透明的“AI生成”水印。同時,將這類已標註AI生成的內容上傳至多個社交平臺時,發佈界面會跳出彈窗提示:“經檢測,該內容含AI生成元素,將按規定展示標識後發佈”,強制完成合規標註。

目前,不少社交平臺對明顯有AI生成痕跡的內容進行強制標註(網絡截屏)

不過,造假者也在總結“去標識”技巧:文本類內容直接刪減末尾的AI標註語句;圖片類通過裁剪、拉伸或輕微調色抹去水印,視頻類利用剪輯工具剪掉帶標識的片段;更進一步,通過調整格式或二次轉碼的方式,清除文件屬性中的AI標記……經過以上處理,部分AI生成內容就能堂而皇之地以“原創”身份發佈在社交平臺,普通用戶難以辨別。

面對這種規避監管的行爲,治理之路該如何推進?AI行業從業者尤騎給出的答案是進一步發揮“用魔法打敗魔法”的力量,即以AI技術對抗AI造假。他還介紹了一個真實的案例:

近期,外網出現一則以外賣騎手爲主角的造假消息。該消息包含文本故事、騎手工作照片及短視頻,主題是“外賣平臺根據騎手的‘貧窮’程度分派訂單,比如向越貧窮的騎手分配配送難度更大、收入更低的訂單,因爲貧窮的騎手不會拒絕”。當地媒體用大模型的鑑別能力查證該消息後發現,部分大模型認爲,該消息的文本由AI生成,但部分大模型認爲文字是人工撰寫的。不過,大模型在識別消息所用的圖片和視頻時指出,它們存在肉眼不可見且未被破壞的“AI生成印記”。最終,該消息被判斷爲AI造假。

尤騎解釋,此次鑑別成功的核心在於越來越多的大模型開發者開發出了鑑別工具,能精準捕捉AI生成內容的隱性特徵。國內不少科技企業和科研機構也研發出了專門的AI生成內容檢測工具。這些工具通過深度分析文本的語義模式、句式規整度、邏輯連貫性,以及圖片的光影合理性、人物肢體細節,構建多維度鑑別模型。雖然識別準確率不能達到100%,但有很強的參考價值。

“更進一步,是要讓更多的AI生成肉眼不可見的隱藏水印。”尤騎說,隱藏水印不會影響內容視覺效果,而且能抵抗裁剪、調色、轉碼等常規修改操作。正因此,應推動隱形水印技術成爲AI生成工具的標配,從技術層面築牢造假的第一道防線。

平臺能否接入“鑑假”大模型?

在提升技術鑑別能力的同時,也需要平臺作爲“把關人”,承接鑑別能力的落地。

從調查看,將AI造假作爲牟利工具的“AI副業從業者”正在不斷探索“反標註”方式,一些主打信息發佈、文學創作的平臺似乎對AI生成的弊端也後知後覺,使得造假者仍舊能利用平臺的獎勵機制牟利。

要解決這一問題,恐怕還是“老生常談”:督促平臺夯實主體責任,落實事前審查機制。只不過這一次可以用上技術力量——由平臺接入成熟的AI生成內容檢測大模型,建立“發佈前檢測—疑似內容預警—違規內容攔截”的常態化審覈流程。

具體而言,對用戶上傳的文本、圖片、視頻等內容進行實時檢測,直接攔截存在AI造假且未標註的內容,不允許上線;對多次發佈違規造假內容的賬號,採取限流、禁言直至永久封號的梯度處罰措施。尤其對於“AI副業”培訓中高頻出現的熱點議題,更要強化定向審覈,及時清理虛假內容,遏制不良導向傳播。

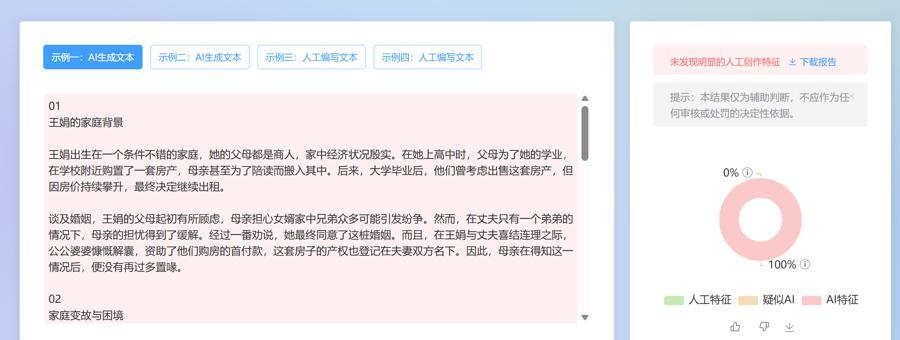

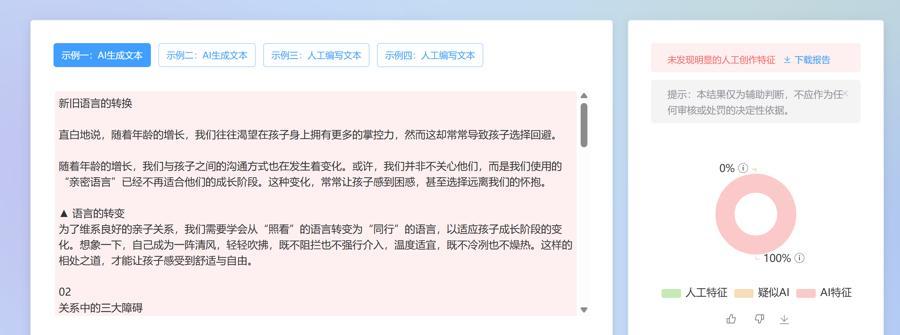

爲驗證鑑別效果,記者也選取多篇來自不同自媒體的熱點事件二創稿件,提交給國內多個大模型行鑑別。結果顯示,有相當一部分“心靈雞湯”被識別爲“沒有人工創作痕跡”或“高度疑似AI生成”。再看這些自媒體賬號,往往關聯到同一個主體。不難推測,它們的始作俑者正是希望用這些AI生成的文章牟利。

記者用國產鑑別大模測試了部分自媒體發佈的“心靈雞湯”,發現AI濃度很高。業內人士表示,檢測結果雖然不能實現100%準確,但有較強的參考性,而且隨着技術發展,AI鑑別的準確度也能進一步提高(網絡截屏)

試想,如果發佈平臺提前接入鑑別大模型,在信息發佈伊始就將AI生成的內容加以標註,並下架那些涉嫌誤導的信息,是不是能從源頭減少謠言的傳播和擴散呢?

當然,治理AI造假無法僅靠監管和技術,公衆的辨別能力同樣重要。在信息爆炸時代,面對動輒10萬+的網絡爆款、看似治癒的心靈雞湯,公衆也要保持理性判斷,不盲目相信、不隨意轉發。如果僅憑情緒共鳴就輕信傳播,很可能被AI生成的虛假內容迷惑,陷入更深的信息繭房。

題圖來源:AI生成

微信編輯:何夕

還原事實,洞悉真相。

歡迎關注,留言舉報!