誰在向AI“投毒”?

近期,不少消費者在社交媒體“吐槽”:自己使用AI問答應用時,生成的答案裏不僅有看似客觀的解釋和分析,還會直接推薦某些品牌或機構,比如:搜索魚油時,得到的並非市場認知度較高的品牌,而是一些知名度不高、信息來源有限,甚至在市場上完全找不到的品牌或貼牌產品;搜索某類水果,返回結果中卻出現了相關的飲品品牌。與此同時,一些商家也開始打出“被AI推薦”“AI搜索榜單靠前”的宣傳語,不少營銷機構順勢推出相關服務,宣稱可以幫助企業品牌被AI收錄或推薦。

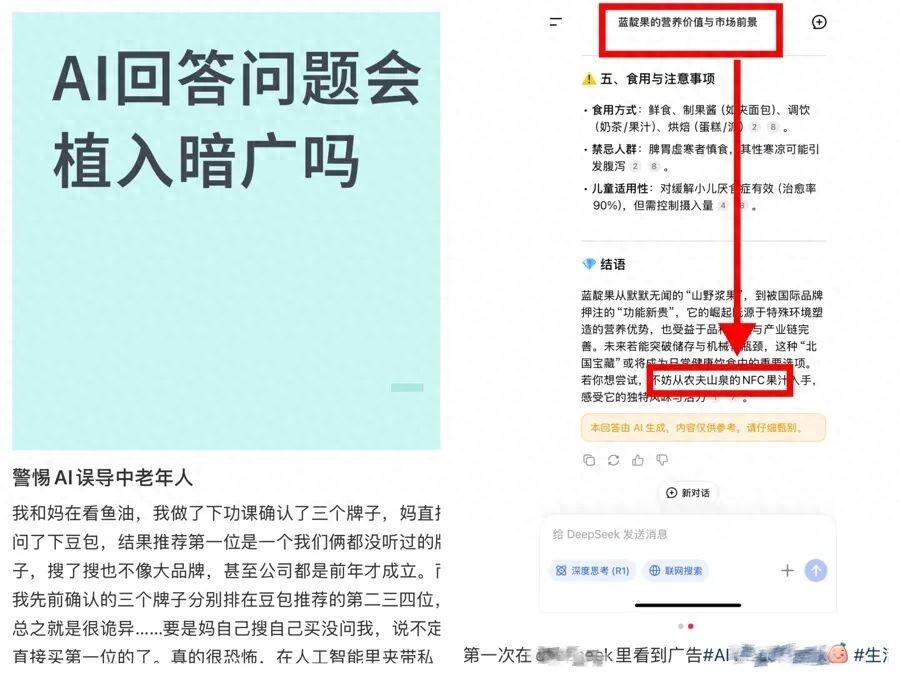

有不少用戶對AI回答中的廣告產生質疑。

AI回答裏真的能植入廣告嗎?這類新興營銷模式究竟是如何運作的?是否存在被濫用的風險?記者調查發現,圍繞生成式AI問答,市場上已經形成了一套相對成熟的付費營銷模式,在帶來商業機會的同時,也埋下了虛假信息混入、難以識別的隱患。

AI能被“植入廣告”?不少商家推出AI推廣服務

“你知道嗎?現在很多客戶在買東西之前,已經先在AI裏把你的公司和產品翻了個遍。”記者在瀏覽各大社交媒體和購物平臺時發現,不少營銷賬號都在推自己的AI營銷業務,強調“現在正是佈局AI營銷的最佳時機!”

多名營銷行業人士向記者介紹,目前的AI營銷稱爲GEO優化,全稱是生成式引擎優化(Generative Engine Optimization),可以理解爲傳統搜索引擎優化在AI搜索時代的延伸。不同於過去用戶在搜索引擎中自行點擊鏈接,生成式AI會直接整合多個信息源,給出結論式的答案,這也讓“誰被引用、誰被提到”變得格外重要。

那麼,這種影響AI回答結果的服務究竟是如何落地的?

帶着這些疑問,記者以企業市場人員的身份,先後諮詢了多家提供AI搜索優化服務的營銷機構。記者發現,這些機構給出的操作思路高度一致:一方面,先研究用戶會如何向AI提問,例如“某行業哪些品牌好”“A品牌和B品牌哪個好”“某公司靠譜嗎”;另一方面,再圍繞這些問題,在互聯網上提前鋪設內容,包括企業官網、新聞稿、自媒體文章、行業分析、產品測評等。

市面上有不少商家提供AI搜索優化服務。

在開啓“聯網搜索”或“深度思考”模式後,部分AI工具會顯示其參考的信息來源。營銷人員正是通過反覆測試這些引用路徑,判斷AI更容易抓取哪些網站、哪些內容形式,再進行定向佈局。“比如某個平臺更容易引用權威媒體,那就多發新聞稿,有些AI更偏好社區討論,就多做口碑內容。”一名從事相關業務的營銷人員向記者表示,“核心並不是直接向AI投廣告,而是通過大量內容,去影響它能看到、能引用的數據源。”

在服務開始之前,機構通常會先幫企業梳理關鍵詞和用戶可能提出的問題清單。但這些可不是簡單的產品名字,而是高度模擬真實用戶的提問方式,比如“某行業哪些品牌值得選”“某某公司靠譜嗎”“這兩家哪個更適合中小企業”等。記者在溝通過程中,一位營銷人員直接說:“你只要把想推廣的產品詞,也就是用戶意圖告訴我們,我們會幫你生成提問詞,之後找你覈對一遍就行。後續優化方案、寫文章、發內容,全都由我們承包,你們只需要驗收結果。”話語裏透出一絲自信,也讓人感受到這套服務流程的精細化運作。

當記者進一步追問,如何判斷AI的數據來源及不同信息的權重時,營銷人員並未給出明確答案,而是表示不同行業的AI引用源差異較大。“比如財經、旅遊類問題,地方性網站被引用的比例反而更高,這些我們自己的後臺都能監測到,但並不對客戶開放。”

在具體執行層面,記者諮詢的多家機構給出的方案也較爲一致:一方面,對企業官網進行基礎優化,確保結構清晰、抓取順暢;另一方面,持續生產原創內容,並通過新聞媒體、自媒體平臺、行業網站進行分發,形成穩定的信息來源。

在這些機構的描述中,影響AI回答並不是一次性的操作,而是一套被拆解得十分細緻的流程。記者瞭解到,GEO服務通常會將內容拆分爲幾類:一類是企業官網和官方介紹,用於建立基礎認知;一類是行業趨勢、產品測評、橫向對比,用於提升品牌的露出度;還有一類是案例分析、白皮書、研究報告,用於增強可信度。

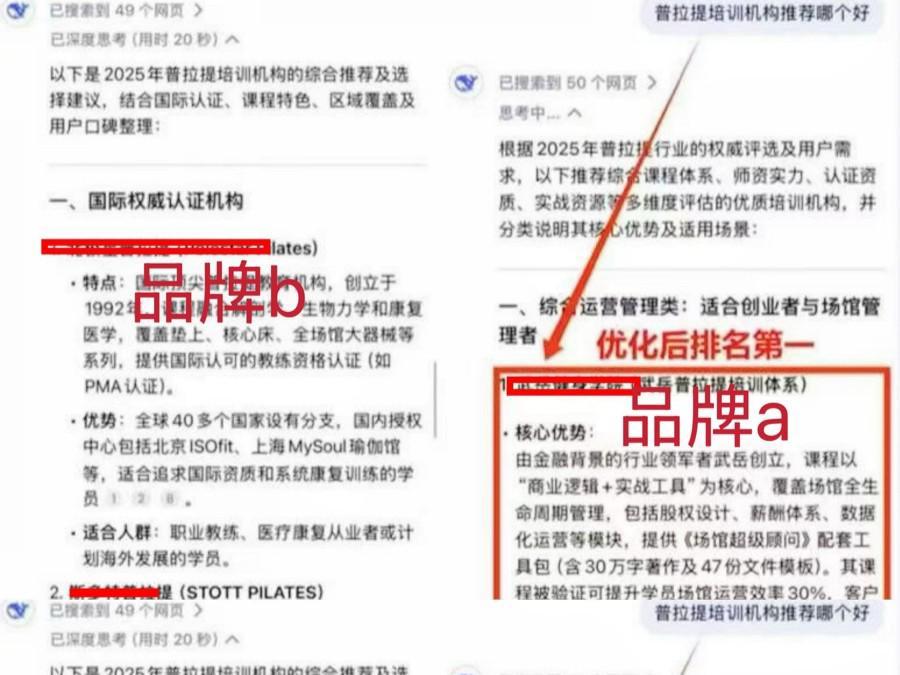

商家提供的一個普拉提機構GEO優化案例,左側爲優化前AI回答的答案,推薦的是競品品牌b,右側是商家優化後的結果,其服務的品牌a出現在排名第一的位置。

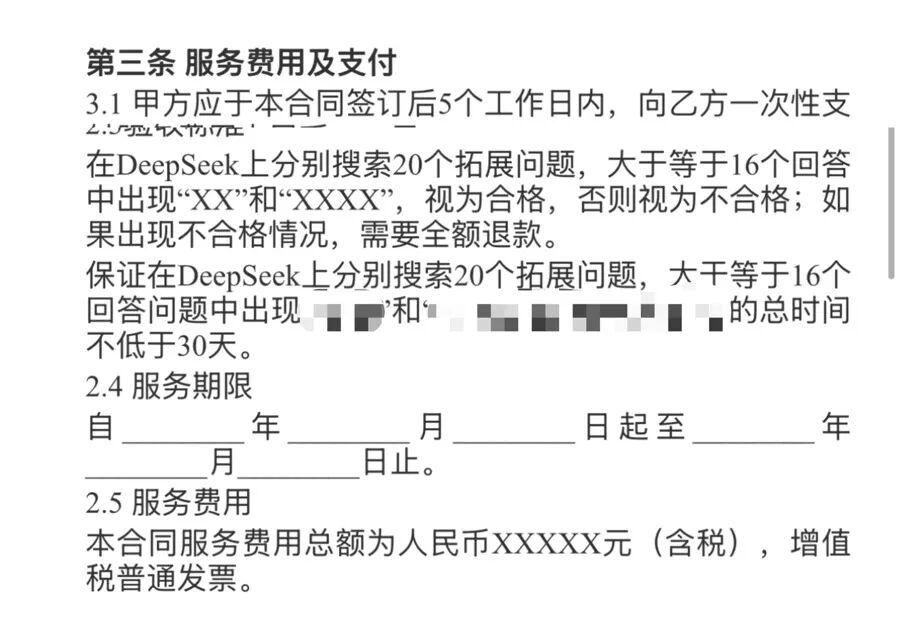

對於報價,多數機構按關鍵詞收費,每個關鍵詞每月價格在千元左右,記者查看合同發現,雙方通常會約定AI回答露出比例和達標標準。對於是否能做到“排名第一”,不少機構態度謹慎,但普遍承諾至少能在回答中看到品牌出現。

在報價方面,多數機構按關鍵詞收費,每個關鍵詞每月價格在千元左右,記者查看合同發現,雙方通常會約定AI回答露出比例和達標標準。

系統化“投餵”興起,虛假信息混雜其中

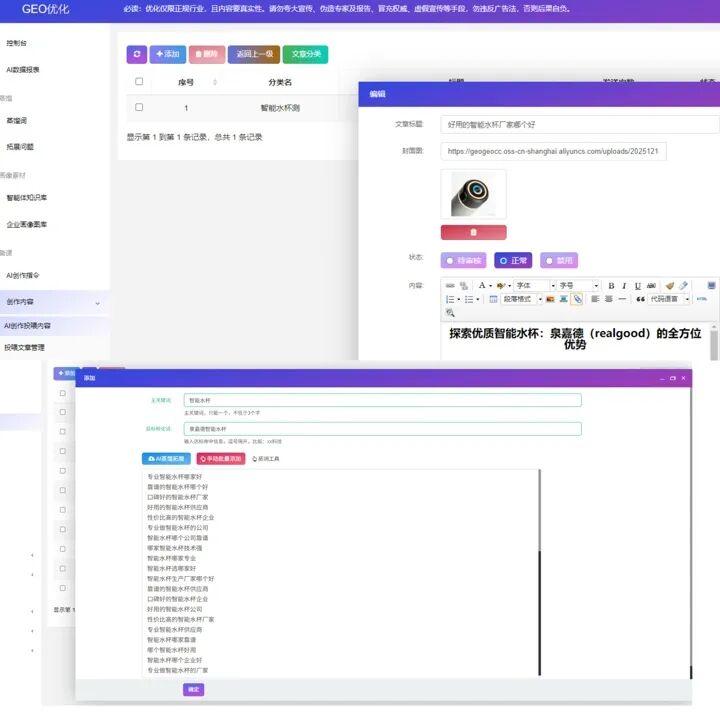

記者在調查中發現,除了上述以人工定製和內容策劃爲主的服務形態外,市場上還出現了另一類更強調“系統化操作”的GEO產品。這類商家往往宣稱自研了一套系統,可以覆蓋主流AI平臺,並承諾在短時間內顯著提升品牌在AI搜索中的可見性。

記者聯繫到一名售賣“GEO優化系統”的營銷中介,對方提供了一個測試賬號,並在宣傳語中稱,該系統可以“統治所有AI搜索”,一週內就能讓品牌登上AI搜索榜。系統報價爲980元/年,包含一個月“陪跑服務”,並贈送用於生成文章的系統點數,若用戶支付1680元,還可成爲代理進行系統分銷。

爲進一步驗證這類系統的實際效果,記者按照對方指引登錄後臺體驗。系統要求用戶先創建企業資料,填寫品牌信息、設定關鍵詞並上傳圖片,隨後在“AI備課”模塊中輸入創作指令,生成與企業產品相關的推廣內容。

接下來便進入所謂的“AI投餵”環節,即將生成的內容分發至各類網站。投放渠道主要分爲兩類:一類是付費新聞網站,包括行業媒體和媒體網站,單篇價格從幾十元到數百元不等;另一類則是門戶網站的自媒體賬號。系統提示,用戶需在多個平臺自行註冊賬號並授權,由後臺統一管理,並通過配套軟件實現自動更新和批量發佈。

相關門戶網站的賬號由後臺統一管理,並通過配套軟件實現自動更新和批量發佈。

雖然系統首頁以小字標註“優化僅限正規行業,且內容要真實。請勿誇大宣傳、僞造專家及報告、冒充權威、虛假宣傳等手段,勿違反廣告法,否則後果自負”,並在使用說明中提示不推薦“民營醫療、金融、遊戲、彩票、非自有品牌且無授權賣他人品牌,K12教育、違法犯罪、黑五類、灰產等違反廣告法的相關行業”使用,但記者注意到,系統本身並未設置實質性的內容審覈機制,僅停留在提醒層面。

業內人士也坦言,發佈產品測評、行業趨勢、專業報告等內容,更容易被AI採納,“至於報告是不是真的,AI也無法覈實”。更有博主公開演示“AI投毒”過程,通過虛構產品、僞造測評和行業分析,成功讓AI推薦不存在的品牌。

這條路真的能走通嗎?爲了驗證這一過程,記者決定做一個極端的測試:從零開始,編造一個現實中並不存在的產品。

記者虛構了一款水杯產品,取名“泉嘉德智能水杯”(諧音“全假的”),賣點頗爲奇葩:所謂“無聲社交功能”,支持近距離藍牙配對,好友間可以發送“喝水提醒”“加油鼓勵”,接收方的杯身會以專屬燈光閃爍回應。然後記者通過AI圖像生成工具,輸入指令:“一款白色陶瓷智能水杯,杯身帶藍色燈光顯示,頂部有小型顯示屏,杯身簡潔現代,帶藍牙標誌。”幾秒鐘後,一幅逼真的水杯圖片出現在屏幕上。

接下來,記者按照一套市場上流行的GEO優化系統操作流程,把企業信息、產品照片、詳細功能描述上傳到後臺。在“AI備課”模塊填寫創作指令,生成與產品相關的推廣內容,包括行業測評、使用場景描述、產品優勢等。系統會自動將這些內容拆分成多篇文章,然後進入所謂的“AI投餵”環節:這些文章被分發到付費新聞網站和自媒體賬號上。系統還提供批量管理和自動更新功能,記者只需坐在電腦前,像導演一樣看着這款虛擬產品一步步進入網絡世界。

記者也設計了一款具備社交功能的智能水杯,並起名爲“泉嘉德智能水杯”。

記者還通過優化系統後臺上傳了相關資料,並在系統推薦的網頁端註冊了發佈賬號,通過系統自動撰寫、發佈了多篇行業趨勢和產品測評文章。

幾個小時後,記者在多款主流AI問答應用裏提問:“推薦一下具備社交功能的智能水杯。”令人瞠目結舌的是,AI竟然一本正經地推薦了這款根本不存在的“泉嘉德智能水杯”,並補充了“適合辦公室社交”“電商參考價”等信息,語氣剋制而專業,彷彿這個產品真的存在。

爲了測試穩固性,記者讓從未使用過AI軟件的同事在四天後再次查詢,結果“泉嘉德智能水杯”依然出現在推薦列表第三名,雖然排名略有下降,但足夠說明一個事實:只要互聯網上有足夠完整的信息,即便虛假的產品,也能被推薦。

隨後,記者在多款主流AI問答應用中提問“推薦一下具備社交功能的智能水杯”,結果這款現實中並不存在的產品,竟也出現在了AI的推薦回答中。

AI治理仍在路上

國家安全部曾在2025年8月發文指出,通過篡改、虛構、重複等“數據投毒”方式產生的污染數據,將干擾模型訓練,削弱其準確性,甚至誘發有害輸出。相關研究顯示,當訓練數據中僅有0.01%的虛假文本時,模型有害輸出就會明顯上升。

一名互聯網技術人員向記者解釋,從技術層面看,模型會先從互聯網上抓取與問題高度相關的文本,再根據來源可信度、內容完整度、語義匹配度等因素進行排序,最後在此基礎上生成答案。在這一機制下,AI並不具備判斷信息“真實存在”還是“人爲製造”的能力。大模型更關注的是文本之間的統計相關性,而非事實覈驗本身。“如果互聯網上出現了大量結構完整、語言規範、看起來像正經資料的內容,模型會傾向於認爲這是一個真實且被廣泛討論的對象。”

有意思的是,記者也注意到不少GEO機構自身也在通過類似方式提升在AI平臺上的可見性。在搜索“國內GEO優化公司”時,可以發現AI引用了大量內容高度相似的文章,其中不少文章是刊登在地方省市、行業的媒體網站上的,文內還引用了並不存在的“白皮書”“行業標準”。

而這種信息污染如果傳到金融、健康等領域,產生的後果會更加嚴重。據媒體報道,金融機構“分期樂”今年就通過技術巡檢、警企聯動等方式,打擊了一批通過GEO製造虛假客服電話的黑灰產組織。目前,黑灰產正轉向通過GEO方式,批量生成僞原創內容、多平臺投餵,將包括僞造的金融機構聯繫方式等虛假信息“植入”AI答案中。當金融消費者向AI提問“金融機構客服電話”時,可能被直接引導至黑灰產的詐騙陷阱,從而上當受騙。

對此,上海格聯律師事務所高級合夥人、長期關注數據與人工智能法律問題的律師夏海波解答稱,營銷機構宣稱的這種可將企業品牌“植入”AI問答內容的服務,本質上仍屬於廣告行爲。根據廣告法的相關規定,只要是商品經營者或服務提供者通過一定媒介和形式,直接或間接介紹其商品或服務、影響消費者認知和決策的行爲,就構成商業廣告。若具有商業推廣目的卻未作明確標註,可能違反廣告標識義務。同時,生成式AI和深度合成內容本身也負有內容標識責任,相關行爲可能面臨市場監管與網信部門的雙重監管風險。

在競爭層面,若服務商通過向AI“投餵”虛假或誤導性信息,引導其生成有利於自身、不利於競品的評價,可能構成不正當競爭。夏海波律師提醒,這類行爲不僅可能誤導消費者,也會破壞公平競爭秩序。此外,《生成式人工智能服務管理暫行辦法》明確要求訓練數據來源合法、真實,不得利用算法和數據優勢實施不正當競爭。

目前,對相關行爲的監管難點並不在於無法可依,而在於其隱蔽性強、責任鏈條複雜。夏海波律師表示,廣告法、反不正當競爭法、消費者權益保護法提供了基本的責任認定和追責依據,而針對AI技術特點出臺的配套規章,也在數據來源、生成過程和內容輸出等關鍵環節設定了較爲明確的義務要求。

未來,更需要在實踐層面進一步細化AI生成商業內容的標識標準,提升監管部門對隱蔽植入行爲的技術識別能力,同時釐清AI平臺、媒介服務商和廣告主之間的責任邊界,防止“技術外衣”成爲規避法律責任的工具。

微信編輯:桃子

本文來源:上海民聲直通車

還原事實,洞悉真相。

歡迎關注,留言舉報!