一篇論文引發存儲芯片股暴跌,Google 的「DeepSeek 時刻」來了?

看過 HBO 神劇《硅谷》(Silicon Valley)的朋友,想必都對那個名爲 Pied Piper(魔笛手)的虛構公司念念不忘。

在劇中,男主角 Richard Hendricks 發明了一種「中間壓縮算法」,能以極高的壓縮率無損處理文件,甚至因此改寫了整個互聯網的規則。

當時我們都以爲這只是編劇的腦洞。直到 Google Research 正式發佈了名爲 TurboQuant 的 AI 壓縮算法。

這原本是一條枯燥的技術新聞,卻在社交網絡上引發了病毒式傳播,不到 24 小時,就收穫了 1280 萬次瀏覽。原因無他,這項技術的設定簡直就是 Pied Piper 的翻版:

在不損失模型性能的前提下,將 AI 的「工作記憶」壓縮至少 6 倍。

市場的反應也極爲真實,美股存儲芯片板塊盤中遭遇拋售,美光科技、閃迪等頭部企業股價齊齊收跌。

這不禁讓人好奇,一項純軟件層面的算法創新,爲什麼會讓賣硬件的先慌了神,而 Google 到底向當前的 AI 牌桌上扔了一張怎樣的底牌?

困在「記憶黑洞」裏的大模型

拋開網絡熱梗,TurboQuant 的出現其實不僅是爲了好玩,更是爲了解決一個讓整個 AI 行業頭疼已久的真實瓶頸。

衆所周知,現在的 AI 模型越來越大,對顯存的胃口也像無底洞一樣。尤其是在推理階段(也就是你和 AI 聊天的時候),AI 需要記住上下文信息,這部分數據被稱爲 KV Cache(鍵值緩存)。

每處理一個詞,模型都要把它轉成一個高維向量存進 GPU 顯存。對話越長,這份「數字備忘錄」膨脹越快,很快就把 GPU 顯存塞滿。這就是爲什麼你的 AI 助手聊久了會「變笨」或者直接報錯,腦容量不夠了。

更棘手的是,傳統的壓縮方法一直面臨一個兩難困境:壓縮數據時,需要額外存儲「量化常數」來告訴模型怎麼解壓。這些元數據聽起來很小,加起來卻能把壓縮帶來的收益全部抵消掉。

Google 的 TurboQuant 的誕生正是基於此。

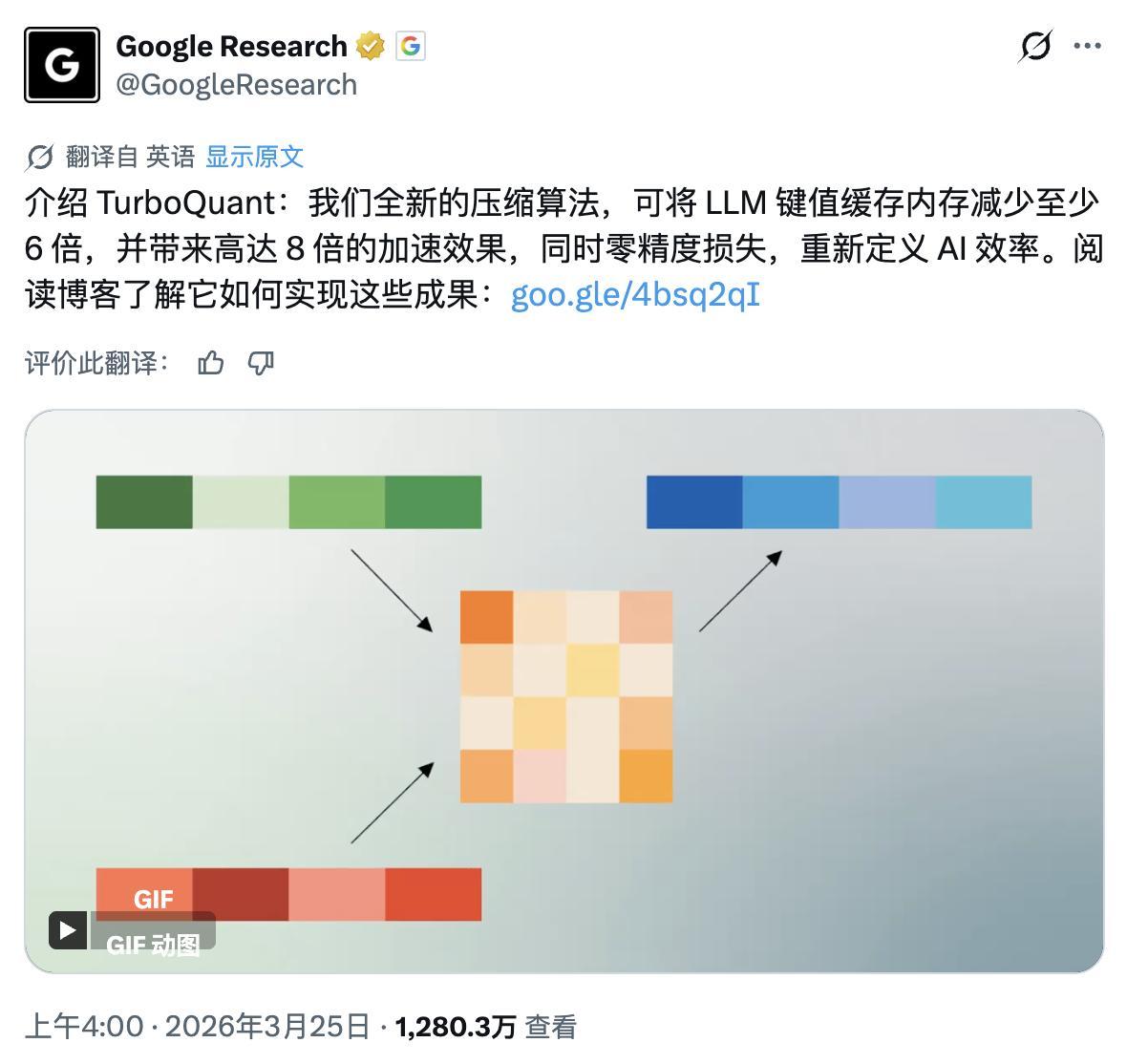

研究人員設計了一套兩階段的數學解法。第一階段叫 PolarQuant,把數據向量從傳統的直角座標系轉換成極座標系,拆分成「半徑」(表示大小)和「角度」(表示方向)。

這個幾何變換的妙處在於:轉換后角度的分佈變得高度可預測,模型不再需要爲每個數據塊單獨存儲昂貴的歸一化常數,直接映射到固定的圓形網格上就行了,開銷爲零。

第二階段叫 QJL(量化 Johnson-Lindenstrauss 變換),充當數學層面的糾錯器。它把壓縮後殘留的誤差投影到低維空間,再把每個誤差值壓縮成一個符號位(+1 或 -1)。

這個設計保證了 AI 在計算「注意力分數」時,壓縮版本的結果與高精度原版在統計意義上完全一致。所謂注意力分數,就是模型判斷上下文裏哪些詞最重要的關鍵步驟。

如果說以前 AI 記筆記是「逐字逐句抄寫」,那麼 TurboQuant 就像發明了一套「極簡速記符號」:該記的一個不漏,佔的空間卻少了六倍。

這套方法還有一個對企業來說格外友好的特性:無需重新訓練模型。你現有的開源模型,或者自己微調過的模型,直接套上 TurboQuant 就能跑,不用額外的數據集,也不用重新跑一遍訓練流程。

光說不練假把式,在「大海撈針」基準測試裏,讓 AI 從 10 萬個詞裏找出一句藏好的話,TurboQuant 在 Llama-3.1-8B 和 Mistral-7B 上跑出了滿分召回率,同時把 KV Cache 的顯存佔用壓縮了至少 6 倍。

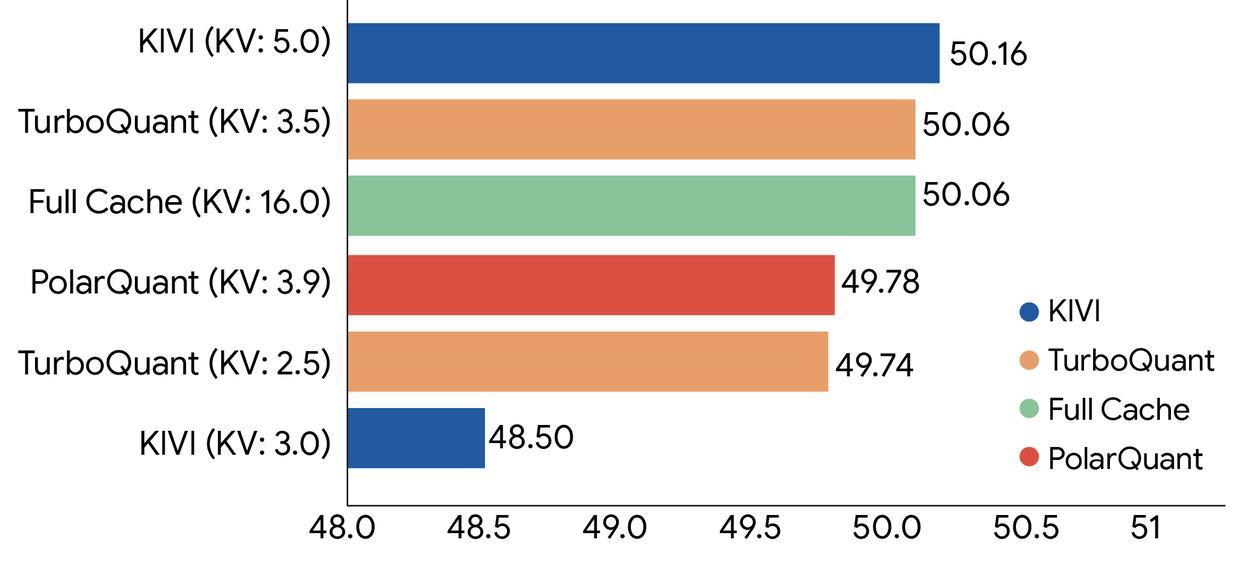

在 LongBench 綜合評測套件(涵蓋問答、代碼生成、長文摘要)上,TurboQuant 全面追平甚至超過了此前的最強基線方法 KIVI。

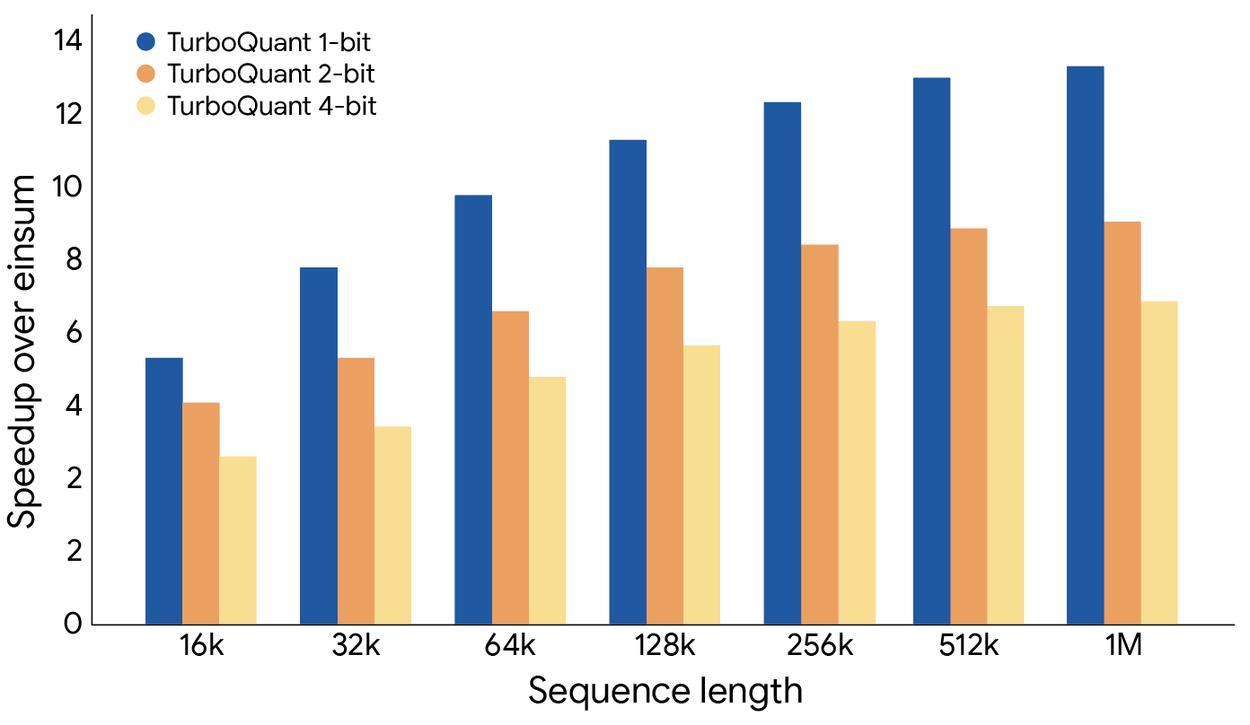

最硬核的數字來自英偉達 H100 GPU 的實測:4 位精度的 TurboQuant 在計算注意力邏輯上的速度,比未壓縮的 32 位方案快了整整 8 倍。

論文發佈後的 24 小時內,社區已經開始動手驗證。

Apple Silicon MLX 框架的知名開發者 @Prince_Canuma 把算法移植到了 Apple Silicon 的 MLX 框架,測試 Qwen3.5-35B 模型,上下文長度從 8500 到 64000 token 全覆蓋,每個量化等級都跑出了 100% 的精確匹配。他還發現,2.5 位的 TurboQuant 能把 KV Cache 壓縮近 5 倍,準確率零損失。

Google 的「DeepSeek 時刻」?

對於 TurboQuant 的發佈,Cloudflare CEO Matthew Prince 甚至將其稱爲 Google 的「DeepSeek 時刻」。

把時間撥回一年前,DeepSeek 以極低的成本訓練出了性能驚人的模型,徹底打破了硅谷大廠對高成本才能訓練出高性能 AI 的迷信。那次衝擊也讓整個行業意識到:光有大模型不夠,還得跑得起、跑得快。

TurboQuant 也是這種背景下的產物。如果這項技術能從實驗室走向大規模應用,它將帶來肉眼可見的商業價值。同樣一張 H100,推理成本理論上可以直接打折超過 50%;端側部署的門檻也會大幅降低,以前需要 32 位精度才能跑的大模型,放在 Mac Mini 或者本地服務器上也能運行,還不會有質量損耗。

市場的反應,已經很說明問題了。TurboQuant 發佈當天,美股存儲芯片板塊盤中遭遇明顯拋售。閃迪、美光科技等頭部企業股價顯著收跌,存儲芯片與硬件供應鏈相關指數單日跌幅超過 2%。

究其原因,如果 AI 巨頭能用一套純軟件算法把顯存需求砍掉六分之五,那些押注 AI 會持續瘋狂消耗高帶寬顯存的多頭,就得重新盤算自己的倉位了。

而這種防禦性反應背後,也表明,過去兩年支撐存儲股估值的核心邏輯之一,是 AI 對顯存的需求只會越來越大。TurboQuant 第一次在技術層面正式動搖了這個假設。

當然,雖然聽起來很美好,還是要潑一盆冷水。

一方面,歷史上每次效率提升,往往反而帶動了總需求增長,經濟學裏叫「傑文斯悖論」。AI 跑得更便宜,可能意味着更多人更頻繁地用它,最終消耗的算力反而更多。所以這場「顯存危機」到底會不會因此化解,還真不好說。

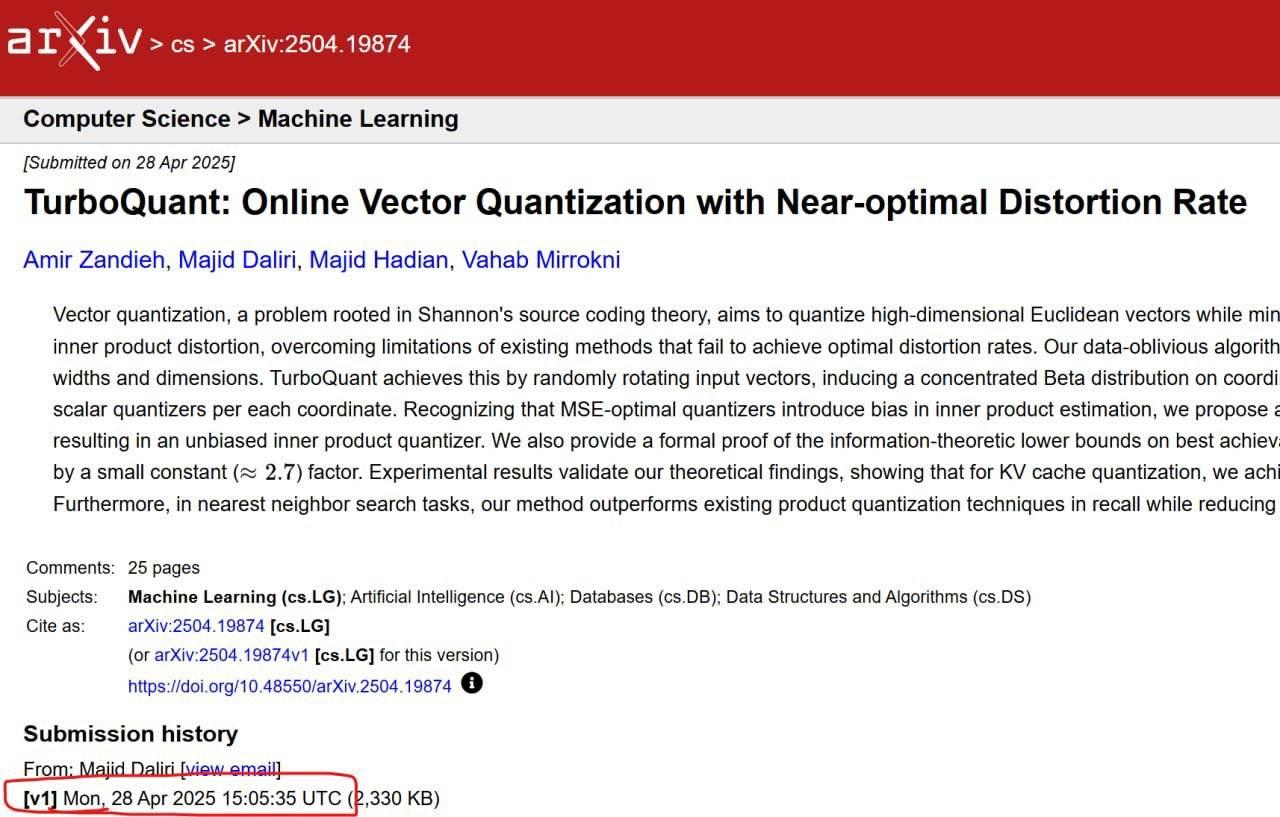

另一方面,TurboQuant 目前仍處於實驗室階段,根據最新消息,Google 計劃在下個月的 ICLR 2026 大會上正式展示這項技術,屆時還將同步亮相另一場頂會 AISTATS 2026。

但從論文到大規模生產部署,中間隔着工程適配、不同架構的兼容性測試、真實場景的性能驗證,每一關都不輕鬆。

論文地址:

https://arxiv.org/abs/2504.19874

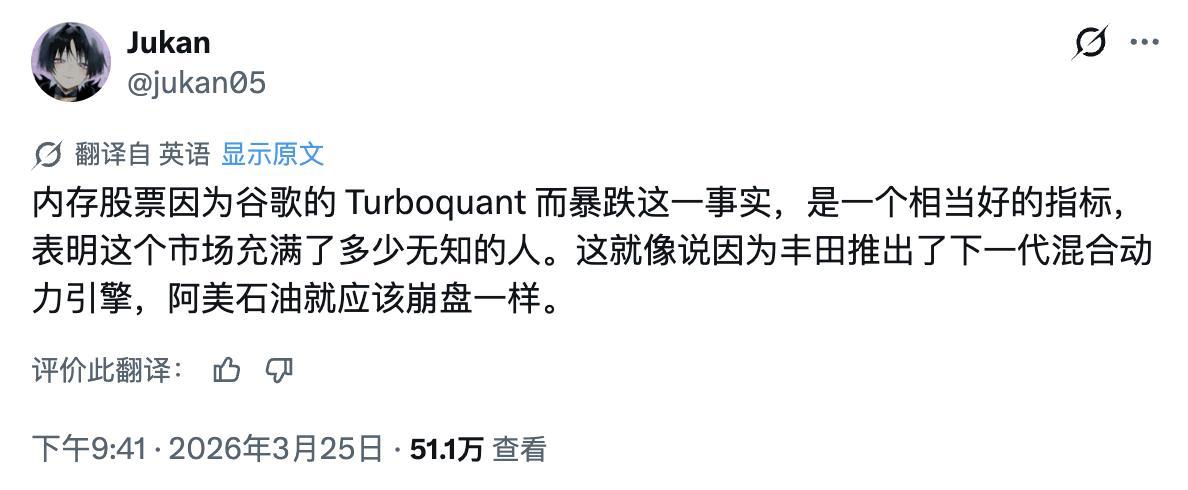

有網友直接開炮,這篇論文的底層研究其實早在去年四月就已公開,根本談不上橫空出世,眼下的輿論熱潮,多少有點追着舊聞起鬨的意思。

在他看來,如果存儲股因爲一篇算法論文而大跌,恰恰暴露了市場裏有多少人根本沒搞清楚這件事的邊界,並把這波反應比作「豐田出了新混動引擎,石油就該崩盤」。

更重要的是,TurboQuant 解決的只是推理(Inference)階段的顯存瓶頸,訓練階段的顯存消耗依然是另一座大山。想從頭訓練一個主流量級的大模型,需要的算力資源依然是天文數字。

在《硅谷》裏,Pied Piper 的壓縮算法最終改變了整個互聯網。而在現實中,TurboQuant 的野心沒那麼大,目標只是讓 AI 在有限的物理空間裏記得更多、算得更快、跑得更便宜。

現實終究不是好萊塢劇本,不必徹底改變互聯網,能和 AI 聊得更長、不再半途報錯,已經是很多人想要的了。

附上 TurboQuant 官方技術博客:

https://research.google/blog/turboquant-redefining-ai-efficiency-with-extreme-compression/

#歡迎關注愛範兒官方微信公衆號:愛範兒(微信號:ifanr),更多精彩內容第一時間爲您奉上。