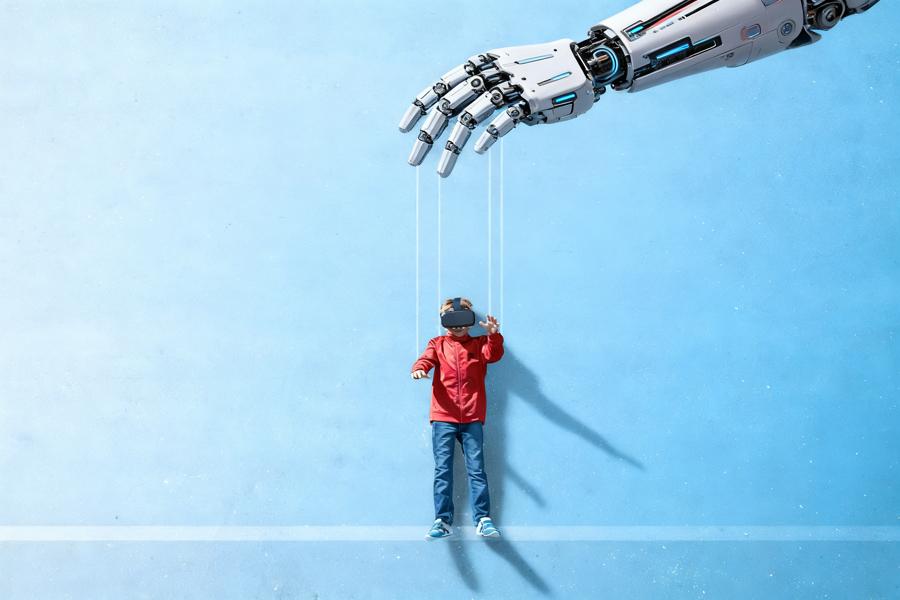

AI讓人類變笨,還是人類拉低了AI智商?兩千年前的擔憂,今天再現

越來越多研究表明,當人們對生成式AI工具的依賴與日俱增,其思考能力和批判性思維水平可能正被削弱。不過,這種趨勢並非不可逆轉。

古希臘哲學家蘇格拉底並不推崇“好記性不如爛筆頭”。這位舉世聞名的哲學家從未留下任何著作,他堅信,對文字的依賴會破壞記憶力、削弱心智。不過,大量研究顯示,將信息寫下來反而有助於記憶形成,這一2400多年前的擔憂似乎並未成真。

然而,蘇格拉底對信息工具的警惕在今天又被提起。越來越多心理學家、神經科學家和哲學家開始擔心,ChatGPT等生成式AI工具可能會削弱人類大腦的記憶和推理能力。

蘇格拉底的觀點論證主要靠巧妙的語言技巧,而當代研究者的擔憂則有着實證研究的基礎。相關研究發現,即便是受過專業訓練的人,在使用生成式AI工具時,也會在不知不覺中減少使用批判性思維;要是在學習過程中高度依賴這些工具,還可能削弱大腦不同區域之間的連接,使信息更容易被遺忘。有人曾向谷歌聊天機器人Gemini提問:“AI是否會把人類的大腦變成果凍、記憶變成篩子?”它竟也承認“有這種可能”。

不過,情況並非無可挽回。許多研究者認爲,我們也完全可以將生成式AI轉化爲提升認知表現、增強思維能力的工具。美國紐約州立大學石溪分校的勞倫·里士滿認爲,人工智能未必讓人類變笨,“問題或許在於我們與它互動的方式不夠聰明”。

那麼,人類在使用生成式AI時,究竟哪裏出了問題?爲更好利用這項技術,我們又該如何調整?

認知卸載越多,大腦使用越少

近年來,生成式AI已深度嵌入人們的生活:心理治療師藉助它來優化病例報告;學生靠它撰寫論文;部分媒體機構也對它敞開大門。據報道,美國財經新聞網站《商業內幕》已允許記者在起草稿件時使用AI。

從某種意義上說,這些做法延續了一個已有數千年曆史的傳統——認知卸載,即藉助工具或外部行動來減輕心理負擔。這一策略在日常生活中隨處可見。例如,我們常會在大采購前寫一份購物清單,而不是把要買的東西全部記在腦子裏。

多數情況下,認知卸載確實能提高記憶效率與準確性,同時釋放大腦資源,以處理更復雜的任務。里士滿指出,這種策略本身並無問題。但她與同事瑞安·泰勒在去年發表的一篇綜述中指出,認知卸載也可能對認知能力產生負面影響。

“當你把某件事情進行認知卸載後,幾乎等同於在心理上將它刪除。”里士滿說,“想象一下,當你寫好購物清單,卻忘記把它帶去超市,你還能記住多少需要購買的商品?”

這一觀點得到了多項研究的支持。一項2018年的研究發現,在博物館參觀時,人們用手機拍攝下展品後,反而更難記住展覽內容,因爲我們已在無意識中把記憶任務“外包”給了手機。

這種行爲可能會形成一種循環:認知卸載越多,大腦就使用得越少;而大腦使用得越少,人們就越傾向於繼續認知卸載。“這種情況確實會發生。”英國蘇塞克斯大學哲學家安迪·克拉克說,1998年,他與現任職於美國紐約大學的哲學教授大衛·查爾莫斯提出了“延展認知理論”,即除了我們的心智之外,購物清單、相冊等外部客體,也可作爲認知載體的延展。克拉克並未對這種延展作出價值判斷,但他擔憂,當人們通過生成式AI和在線服務,將更多認知卸載到網絡空間時,一旦遭遇停電或網絡攻擊,人類將變得格外脆弱。

認知卸載還可能使記憶更容易受操控。2019年,加拿大滑鐵盧大學進行了一項研究,研究人員讓志願者記憶一組單詞,並允許他們將單詞打印出來以輔助記憶。當研究者悄悄在打印版本中加入一個原本不存在的“干擾詞”時,志願者普遍確信這個詞本就在原始列表中。

蘇格拉底對文字的警惕,就是一種對認知卸載所帶來的風險的擔憂。而現在,生成式AI的出現使問題進一步複雜化。在一項2024年發表的研究中,美國賓夕法尼亞大學的希裏·梅盧馬德與尹振浩邀請1100名志願者圍繞“如何打理菜園”撰寫短文。志願者中的一部分人使用傳統網頁搜索,另一部分人使用ChatGPT。結果顯示,使用ChatGPT的志願者寫出的文章往往更短,且事實引用更少。研究者認爲,AI使學習過程變得更加被動,對知識的理解也更爲膚淺。換言之,AI替我們完成了信息整合,也讓我們失去了自主探索和發現的機會。

對AI越依賴,批判性思維越退化

對認知卸載的擔憂,最新神經科學研究提供了進一步支持。

在2024年夏天發表的一項研究中,美國麻省理工學院的娜塔莉婭·科斯米娜及其團隊讓54名志願者戴上腦電採集設備,圍繞諸如“真正的忠誠是否需要無條件支持”“選擇過多是否會成爲問題”等主題寫文章。其中,第一組只能依靠自身知識和經驗進行創作,第二組可以使用谷歌搜索引擎,第三組則可使用ChatGPT。

結果顯示,在寫作過程中,使用ChatGPT的一組志願者大腦不同腦區之間的連接性最低;完全依靠自身知識的一組,腦區之間連接性最高;而使用瀏覽器搜索的一組則介於兩者之間。

“確實存在一種風險,這種幾乎無所不能的工具,可能讓人們陷入舒適區,而這種舒適是有代價的。”科斯米娜還指出,大腦活動降低並不一定意味着認知參與減少,要作出判斷還需結合具體的行爲指標。例如,在後續測試中,使用ChatGPT的志願者更難準確複述自己的文章內容,這表明他們對寫作過程的投入程度較低。

此外,還有初步證據表明,頻繁使用生成式AI與減少批判性思維的“認知懶惰”之間存在關聯。瑞士商學院的邁克爾·格爾利希近期評估了具有不同社會背景的666名參與者的AI使用習慣和批判性思維能力。結果顯示,17至25歲人羣的批判性思維得分比46歲以上人羣低了45%左右,而前者自述對AI的依賴程度比後者高出40%至45%。格爾利希認爲,將這兩項數據結合起來看,則可能暗示着“過度依賴AI會削弱批判性思維能力”。

與此同時,美國微軟公司與卡內基梅隆大學對319名知識型工作者,包括科學家、軟件開發者、管理者和顧問,展開了調查。結果發現,對AI越有信心的人,越傾向於承認自己在使用AI時減少了批判性思考。這與格爾利希提出的認知懶惰風險相呼應。

不過,也有學者提醒,目前下定論仍爲時過早。美國肯尼索州立大學的亞倫·弗倫奇指出,格爾利希的研究只揭示了相關性,並未確定兩者的因果關係,且已有研究表明,青少年的批判性思維能力本就未完全成熟。

值得關注的是,生成式AI甚至可能影響那些並不頻繁使用它的人。卡內基梅隆大學社會與決策科學系教授西蒙·德德奧與麻省理工學院博士後扎卡里·沃伊托維奇指出,人們往往會重視某些行爲背後所付出的努力,例如爲修復關係而精心撰寫的一封道歉信,“如果我們懷疑這些複雜的認知任務是由AI來完成的,可能會更難相信對方的誠意”。

人類放棄原創,AI將“模型崩塌”

要想避免上述問題,或許應該嘗試重塑我們與AI的關係,讓它增強我們的認知參與,但這並不容易。格爾利希在一項新的研究中發現,即便是自認爲具有較強批判性思維能力的人,在缺乏明確引導的情況下使用生成式AI,也容易滑向認知懶惰。

可是,一旦有了引導,情況就會變得不同。科斯米娜團隊的補充研究提供了一個案例:研究人員讓那些最初僅憑自身知識寫作的志願者,在第二輪試驗中使用ChatGPT對同一篇文章進行修改。腦電數據表明,即便使用了AI,這些志願者大腦的腦區之間依舊保持了較高的連接性。

“這說明,如果人們在使用AI之前先進行獨立思考,隨後寫出的文章在趣味性、原創性和結構上都會有顯著不同。”克拉克認爲,這一點至關重要。

弗倫奇也持類似觀點。2024年,他與現今已故的同事J.P.希姆合作發表了一篇論文,指出正確使用生成式AI的做法是將其當作增強對既有知識理解的工具,而不是視爲替代學習與理解過程的偷懶捷徑。

那麼,如何纔算“用對AI”?克拉克建議,首先要降低對AI的信任度,“把它當成一個時而很有見地、時而卻完全跑偏的同事”。他還認爲,在使用前思考越多,大腦“混合認知”的表現就會越好。當然,有些時候適度進行認知卸載是合理的。例如,需要整合大量公開信息時,就可以讓人工智能先完成初步彙總,但仍需自行對彙總結果進行覈查。

格爾利希還提醒,要警惕“錨定效應”——這種認知偏差會讓我們在決策時過度依賴最先獲取的信息。這意味着,即便你在批判性地評估AI的回答,也可能已被它最初提供的信息帶偏,從而妨礙真正的原創性思考。

應對“錨定效應”的策略之一是調整向AI提問的方式。例如,若要分析法國大革命的負面影響,不妨先讓AI提供關於法國大革命及與之相關的基本事實,再自行提煉負面因素並進行解釋,最後請AI指出論證中的漏洞或提供反方觀點。

使用AI的效果也因人而異。對正在經歷認知能力下降的人來說,適度“卸載”反而可能有好處。人的性格特質同樣重要。對熱愛思考的人而言,與其讓AI直接“投餵”答案,不如讓它來挑戰你的理解。

或許,這些建議聽上去好像只是一些常識,但克拉克認爲,讓更多人意識到這一點至關重要。原因很簡單:如果人類期待AI提供全部答案,原創內容將逐漸減少,這最終可能讓AI本身遭到反噬——大語言模型依賴人類生成的內容進行訓練,一旦原創內容枯竭,模型便可能陷入以自身產出的數據反覆訓練的循環中,不僅質量逐漸降低,還會喪失創造力。克拉克將這種風險稱爲“模型崩塌”,“因此,確保人類繼續創造出新的、有趣的內容,有着切身的現實利益考量”。

換言之,這場人與AI之間的互動,從來不是單向的。我們擔心AI讓人變笨,但當人類過度依賴AI,也可能會反過來拉低AI的智商。