機器人不會摸黑開燈?上海首發全球最大“視觸覺”數據集,發力“指尖進化”

面向具身智能創新,上海再次做出重要貢獻。記者最新獲悉,全球首個、也是目前規模最大、模態最完整、任務結構最系統化的“視觸覺”多模態機器人操作數據集——白虎-VTouch已在上海正式發佈,標誌着具身智能機器人正在突破“看得見、摸不着”的感知瓶頸,真正向“能觸、能控”的精細化操作階段跨越。

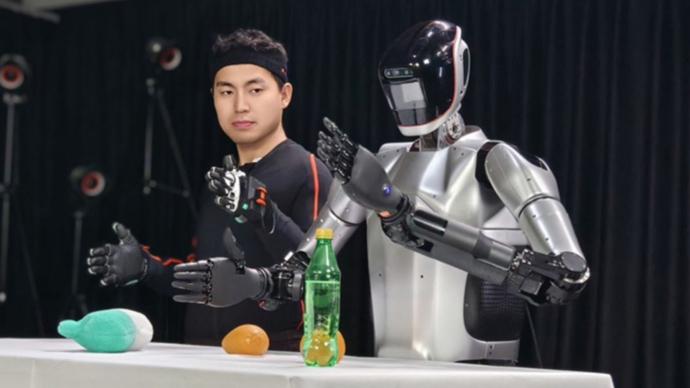

讓機器人與現實世界交互形成海量的語料數據,再通過預訓練讓這些數據轉化爲具身基礎模型,激發出處理複雜問題的“湧現”能力——這已成爲當今提升具身機器人“智力”的核心手段。然而長期以來,具身智能的語料數據來源,大多侷限於視覺傳感器,使得機器人過度依靠“看”來理解世界,缺失了至關重要的觸覺維度。這種感知上的不平衡,使得機器人一旦需要在暗光環境下摸索開關、抓取易碎物品等複雜場景,往往會因爲缺乏高保真的觸覺信息而顯得“笨手笨腳”。

此次發佈的白虎-VTouch數據集,由國家地方共建人形機器人創新中心(下稱“國地中心”)聯合上海緯鈦科技有限公司共同發佈,核心目的就是要補齊具身智能缺失的“觸覺與接觸”數據拼圖,爲構建真正具備物理理解與精細操控能力的具身基礎模型提供關鍵語料與工程底座,進而加速具身機器人的進化迭代。

據介紹,該數據集不僅擁有包含深度信息的彩色圖像(RGB-D)數據、關節位姿數據,更藉助緯鈦科技自研的視觸覺傳感器,記錄軟接觸、硬接觸、滑動接觸等多種物理交互模式下的壓力和形變數據。目前,該數據集總量已超過6萬分鍾,包含視觸覺圖像約9072萬對真實物體接觸樣本。此外,與傳統單一任務的訓練不同,白虎-VTouch的數據採集還首創了矩陣式方法,不僅極大提升了海量數據的採集效率,更顯著增強了機器人的實際應用能力。

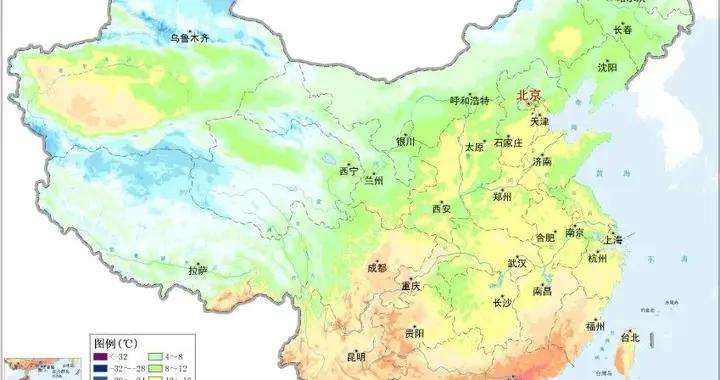

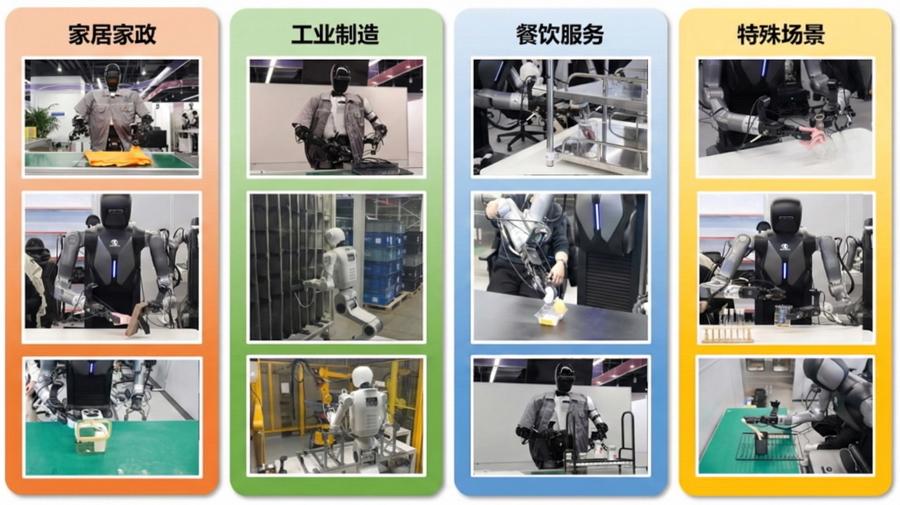

目前,該數據集已覆蓋家居家政、工業製造、餐飲服務、特種作業等四大類真實場景。通過輪式、雙足等多種機器人構型包括手持終端,研究團隊完成了超過380個任務類型,涉及500多種真實物品,涵蓋抓取、插入、旋轉、放置等100多種原子技能,基本覆蓋了約90%的日常生活和工業操作需求,展現出了極強的跨平臺泛化能力。

爲推動具身智能生態的開放與發展,目前,白虎-VTouch的首批6000分鐘數據已正式上線開源社區OpenLoong,這不僅豐富了我國具身智能的技術生態和標準化探索,也意味着全球的具身開發者都可以利用上海這一原創成果,構建更聰明、更靈巧的機器人基礎模型。隨着相關數據的持續完善,未來的機器人將不僅僅是一個“移動攝像頭”,而成爲擁有靈敏觸覺、能像人類一樣處理複雜任務的智能助手。