一次看懂國內外主流AI大模型,5分鐘解決你的AI焦慮

【ZOL中關村在線原創技術解析】過去兩年,AI大模型幾乎成爲科技領域最頻繁出現的關鍵詞之一。從寫作助手到編程工具,從圖片生成到視頻創作,越來越多的產品背後,都有大模型在提供能力支持。

不過,如果仔細觀察會發現,人們在談論“大模型”時,往往指代的並不是同一類。有的擅長處理文本,有的專門生成圖片,還有的同時具備語言、視覺甚至語音能力。

換句話說,大模型並不是單一形態,事實上,目前主流的大模型可以從能力類型上分爲三類:語言模型、視覺生成模型,以及正在快速發展的多模態模型。

語言大模型:AI應用最常見的核心能力

目前最成熟、應用範圍最廣的一類,是語言大模型,也常被稱爲"大語言模型"。這類模型主要圍繞文本展開,可以完成寫作、翻譯、問答、代碼生成等任務,也是許多AI助手和智能工具的核心能力來源。

讓大衆第一次真正感受到大模型能力的產品,是由OpenAI推出的ChatGPT。其背後的模型體系包括GPT-3、GPT-4等多個版本,也推動了整個行業對大模型的關注。此後,不少科技公司都推出了自己的語言模型。例如,Google發佈的Gemini(其早期版本專注於文本交互)、Anthropic的Claude,以及Meta開源的Llama系列。

在國內,語言模型的發展同樣非常活躍,例如阿里巴巴的千問、騰訊的混元大模型(語言版本),以及字節跳動的豆包大模型。這些模型儘管在參數量、訓練數據上各有不同,但核心能力都集中在理解和生成文本上。

語言模型之所以成爲當前大模型生態的核心,一方面是因爲文本數據規模巨大,另一方面也是因爲大量應用場景本身就建立在語言交互之上。隨着大模型能力的持續躍升,它正在悄然改變我們獲取信息的方式,用戶不再需要在海量網頁中自行篩選,而是直接向模型提問,獲得經過整合、提煉的答案。

這種交互模式更接近人類自然的溝通習慣,也大大提升了信息獲取的效率。

因此,大模型正逐步成爲替代搜索引擎的超級入口,它不僅能理解模糊的意圖,還能根據上下文提供個性化建議,甚至主動引導用戶發現新的知識。

文生圖模型:讓創作方式發生變化

除了處理文本,大模型在圖像生成領域的發展同樣迅速,就比如大家常用的文生圖,其實就是這類模型的典型代表。

所謂“文生圖”,就是通過一段文字描述生成對應的圖片。這一類模型通常基於擴散模型技術,近年來在設計、廣告和內容創作領域受到關注。比較有代表性的模型包括Stable Diffusion、Midjourney,谷歌最強文生圖模型Nano Banana 2,以及由OpenAI推出的DALL·E。

對於設計、插畫以及遊戲概念圖等領域來說,這類工具在一定程度上改變了創作流程,也讓更多人可以參與到視覺內容的創作中。

多模態模型:正在融合不同能力

如果說語言模型和圖像模型各自代表一種能力,那麼最近幾年大模型的發展趨勢,則越來越指向多模態。事實上,今天人們所說的"通用大模型",往往指的就是具備多模態能力的模型。

所謂多模態,是指一個模型能夠同時處理多種信息形式,例如文本、圖片、語音甚至視頻。這類模型不再侷限於單一的輸入輸出方式,而是嘗試打通不同模態之間的壁壘。例如,GPT-4(尤其是GPT-4o版本)已經具備強大的圖像理解能力,用戶可以直接"指着"圖片提問;而Google的Gemini在設計之初就強調對文本、圖像、音頻、視頻等多種信息類型的統一處理能力。

這種趨勢意味着,未來的大模型可能不再被嚴格區分爲語言模型或視覺模型,而是逐漸演變爲一種能夠綜合理解和生成多種內容的技術平臺。

值得注意的是,在端側設備上,多模態模型的落地同樣活躍。手機廠商正在將大模型能力集成到設備中,讓AI成爲用戶隨身攜帶的智能助手。

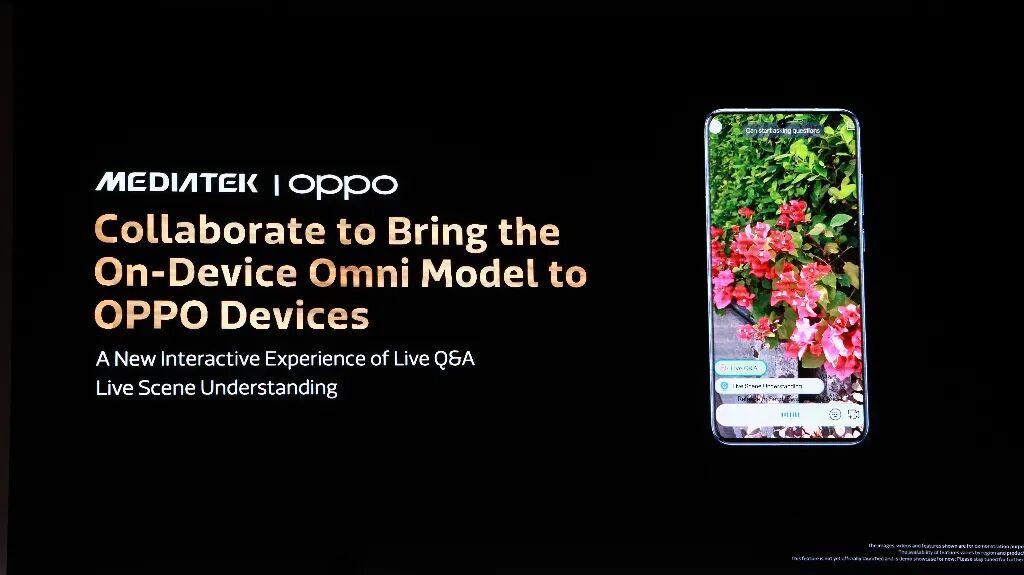

例如,OPPO在MWC 2026上展示了與聯發科聯合研發的端側全模態Omni模型,支持語音、視頻、文本等多種輸入方式,能在無網環境下實現實時翻譯和環境問答。

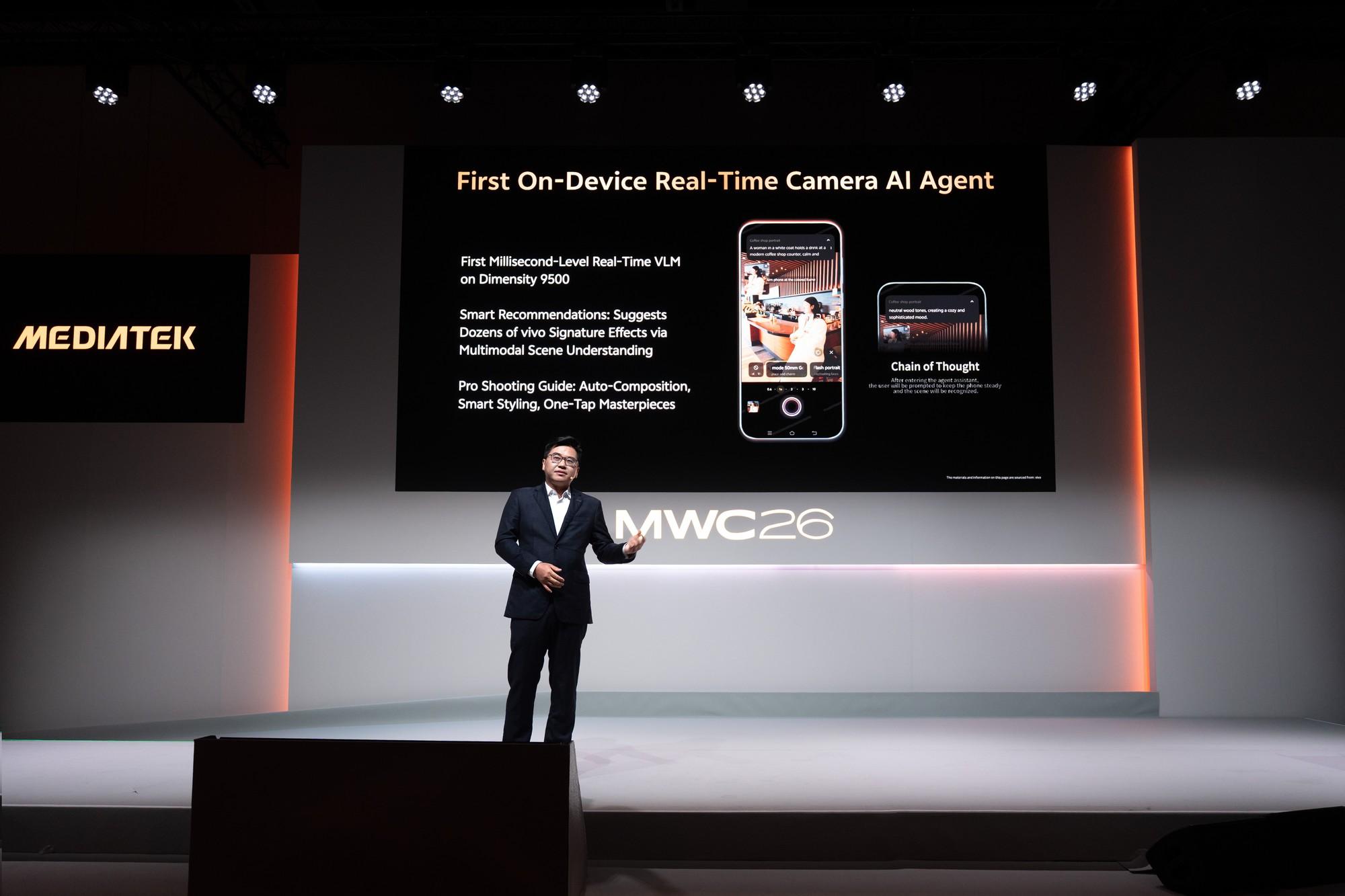

vivo則聚焦於影像與AI的融合,推出了端側相機AI Agent,幫助用戶在複雜光線條件下智能優化拍攝效果。

小米則通過自研的MiMo基座大模型驅動Miloco全屋智能方案,讓智能家居從"被動控制"走向"主動服務"。

這些端側模型的共同特點是:在保護用戶隱私的同時,實現低延遲的實時交互,讓人工智能真正融入日常生活的每個角落。

大模型正在成爲新的技術底座

從整體來看,大模型的發展正逐漸演變爲一種新的技術基礎設施。一方面,科技公司持續訓練更大規模的基礎模型;另一方面,各類應用也在基於這些模型構建新的產品形態。從搜索、辦公工具到內容創作平臺,越來越多的軟件正在接入大模型能力。無論是雲端的通用大模型,還是手機端側的專業模型,都在共同推動智能技術走向普及。

對於普通用戶來說,未來接觸到的大多數AI產品,很可能都建立在這些模型之上。換句話說,人們看到的或許只是某個應用界面,而真正推動變化的,是背後不斷進化的大模型體系。

(11470966)